杜撰虚假文献、引用不存在的名人观点、编造错误数据、将旧事当作新闻传播……基于不完整信息生成看似合理实则错误的答案,让人难以分辨真伪,这种现象被业界称为「AI 幻觉」。

杜撰虚假文献、引用不存在的名人观点、编造错误数据、将旧事当作新闻传播……基于不完整信息生成看似合理实则错误的答案,让人难以分辨真伪,这种现象被业界称为「AI 幻觉」。

「AI 幻觉」是大模型天然存在的隐性缺陷。具体表现在互联网上,大模型只会单纯搜索内容进行推理,无法像人一样判断真假,且不对信息本身的真实性负责。4 月 25 日,李彦宏在百度 AI 开发者大会上坦言 deepseek 存在幻觉多、速度慢等痛点,将「AI 幻觉」这一概念再次拉入大众视野。这个词汇早在 2023 年就显迹在互联网上,但时至今日仍在各大社交平台有具象化呈现。

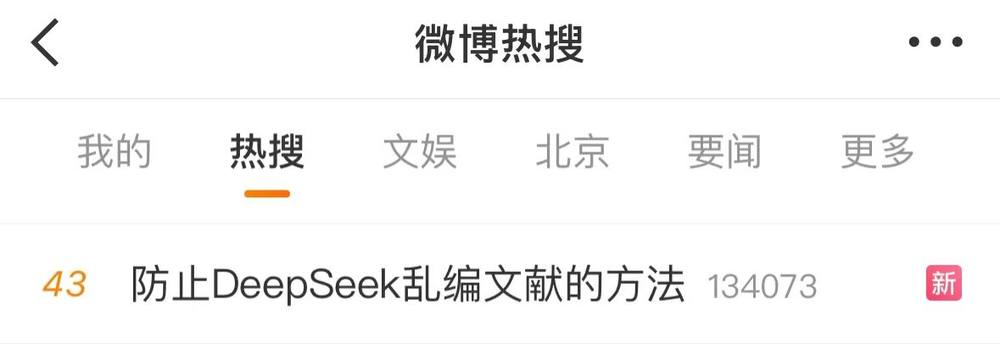

例如在小红书平台,「DeepSeek 生成假的参考文献怎么办」相关帖子达到 5 万条;微博上,# 防止 DeepSeek 乱编文献的方法 # 的话题也冲上热搜。加之一些人不经判断就依赖 AI 走「捷径」,相关争议持续不断。

在 AI 的浪潮下,如何兼顾正确与效率的同时,守护自己的思辨能力?

破解 AI 幻觉,开「AI + 教育」落地新局

面对 AI 大模型「一本正经式地胡说八道」,若想避免被误导,一方面需要正确看待 AI 生成、输出的内容,另外一方面,与 AI 良性互动,而非对其输出结果全盘接受。中国人民大学新闻学院教授卢家银指出,这种现象在知识建构与思维发展层面存在双重隐患:在知识建构上,AI 生成的虚假学术成果,可能扭曲青年对科学方法论的理解,削弱其「假设-验证」的科研逻辑训练。在思维发展上,AI 谣言通过算法推荐的「信息茧房」形成逻辑闭环,不利于批判性思维的培养。

因此,AI 输出内容应被视作认知起点而非终点。我们需要主动验证信息可靠性,例如查阅权威信源、对比多元观点,甚至与领域专家直接交流。除了小心谨慎使用大模型之外,酷开探索出「AI + 教育」场景化落地的另一条路径——让大模型仅承担宏观调度与规划功能,即先由大模型拆解分析题目,再依据具体需求调用适配工具解题。这一思路在搭载教育智能体的酷开 AI 学习机 Y41 Air 上得到实践印证。

从「答题工具」到「思考辅助者」,AI 如何才能讲好一道题

真正有「人味儿」的 AI 教育,始于对技术边界的清醒认知,酷开要做的是让 AI 成为「思考辅助者」,而非答题「工具」。酷开 AI 学习机 Y41 Air 搭载的教育智能体,打破通用大模型的数据泛化问题,通过整合 K12 全学段 10 亿级去重题库,用大量的基础数据规避 AI「天马行空」式的推理的干扰,从底层夯实了大模型解题的准确性与可解释性。

当学生提问时,学习机会遵循「先匹配、再推演」的双轨逻辑,首先在海量题库中精准匹配相似题型,再通过大模型进行解题路径的分层推演,从源头上降低 AI 幻觉风险。以初中几何题为例,酷开 AI 学习机 Y41 Air 如同私人「家教」般,不仅呈现答案与完整推理过程,更通过一对一提问引导的方式,促使学生观察图形特征、自主推导辅助线添加逻辑。

这种在解题过程中融入个性化互动引导的设计,既提升了人机交互的拟真感,更着力培养学生主动思考与分析的思维能力,与传统 AI 答题工具形成了本质区隔。

当前 AI 教育正站在应用普及的十字路口。酷开学习机展现的技术路径表明,化解 AI 幻觉风险不能单纯依赖模型优化,更需要从教育本质出发重构人机关系。在 AI 与教育深度融合的进程中,如何平衡技术能力与教育逻辑,酷开的实践给出了一个值得关注的答案。

来源:互联网