摘要

实现性能、效率和内存的最佳平衡

4 月 7 日消息,阿里云通义千问开源 320 亿参数模型 Qwen1.5-32B,可最大限度兼顾性能、效率和内存占用的平衡,为企业和开发者提供更高性价比的模型选择。目前,通义千问共开源了 7 款大语言模型,在海内外开源社区累计下载量突破 300 万。

通义千问此前已开源 5 亿、18 亿、40 亿、70 亿、140 亿和 720 亿参数的 6 款大语言模型并均已升级至 1.5 版本,其中,几款小尺寸模型可便捷地在端侧部署,720 亿参数模型则拥有业界领先的性能,多次登上 HuggingFace 等模型榜单。此次开源的 320 亿参数模型,将在性能、效率和内存占用之间实现更理想的平衡,例如,相比 14B 模型,32B 在智能体场景下能力更强;相比 72B,32B 的推理成本更低。通义千问团队希望 32B 开源模型能为下游应用提供更好的解决方案。

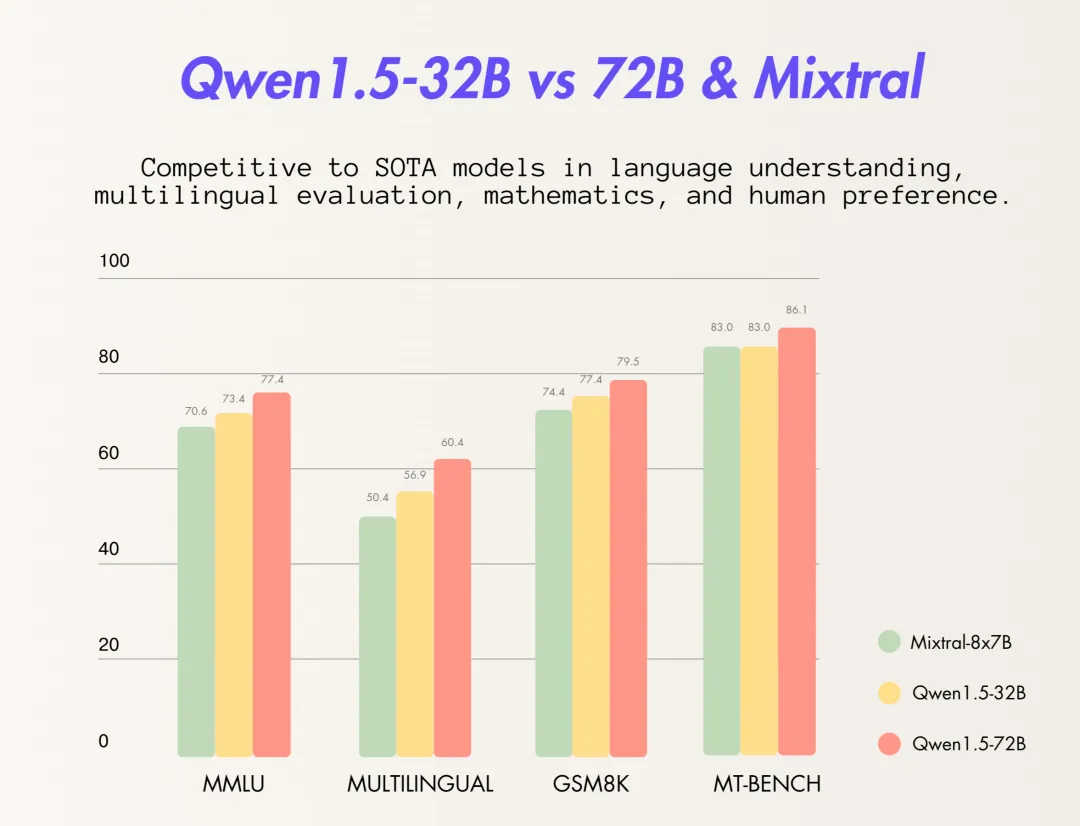

基础能力方面,通义千问 320 亿参数模型在 MMLU、GSM8K、HumanEval、BBH 等多个测评中表现优异,性能接近通义千问 720 亿参数模型,远超其他 300 亿级参数模型。

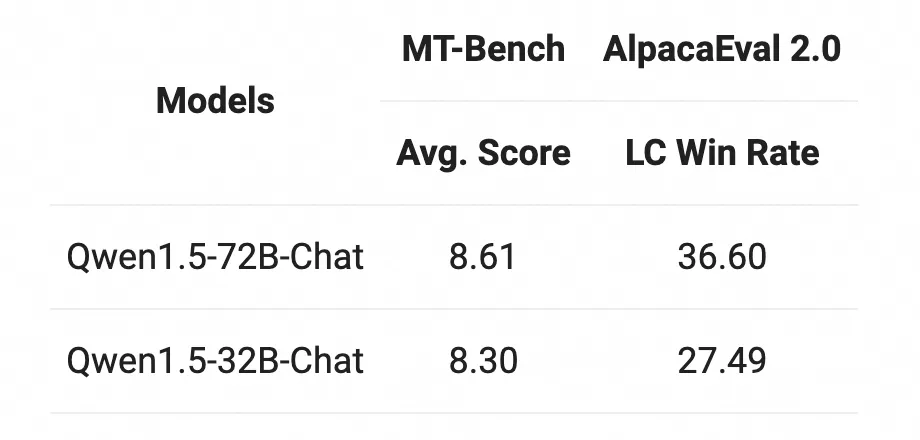

Chat 模型方面,Qwen1.5-32B-Chat 模型在 MT-Bench 评测得分超过 8 分,与 Qwen1.5-72B-Chat 之间的差距相对较小。

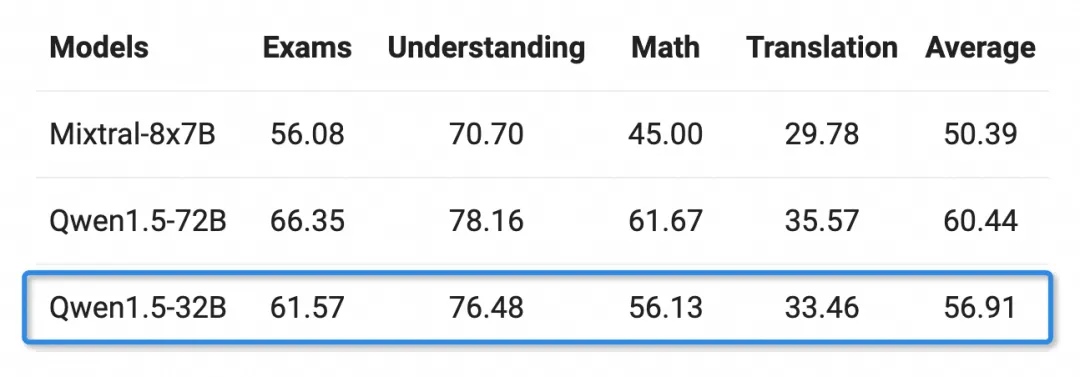

多语言能力方面,通义千问团队选取了包括阿拉伯语、西班牙语、法语、日语、韩语等在内的 12 种语言,在考试、理解、数学及翻译等多个领域做了测评。Qwen1.5-32B 的多语言能力只略逊于通义千问 720 亿参数模型。