今天,我们正式发布新一代3D 生成模型 Seed3D 2.0。

今天,我们正式发布新一代3D 生成模型 Seed3D 2.0。

围绕几何精度和纹理材质,Seed3D 2.0 进行了架构升级,并拓展了 3D 内容的下游可用性,进一步推动 3D 生成迈向「生产可用」。用户输入一张图,即可生成结构更准确、材质更真实的 3D 资产。

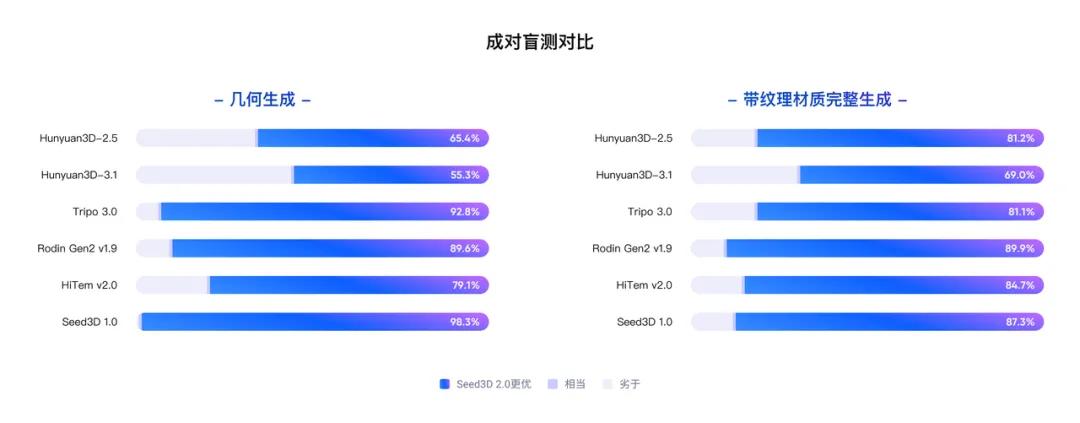

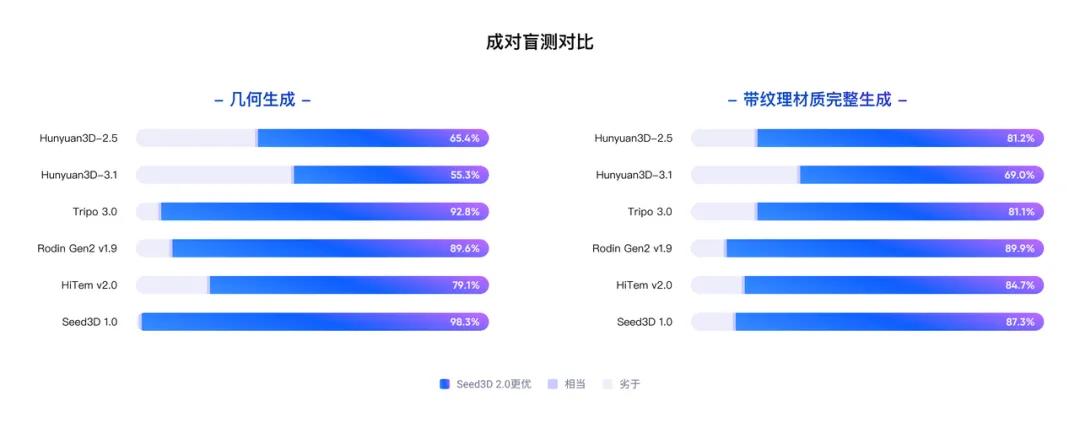

在行业常用的 Pairwise Comparison 盲测中,60 位具有 3D 建模经验的评测者基于约 200 个测试用例,对 Seed3D 2.0 与 6 个主流模型进行两两偏好评估。结果显示,Seed3D 2.0 在几何生成和端到端带材质资产生成两项核心任务上,相比所有参与对比的主流模型均呈现更高的偏好率,在专业测评中被显著感知。

具体而言,Seed3D 2.0 本次升级主要体现在几何生成质量和材质真实感两方面;与此同时,我们也围绕仿真、具身智能等下游场景持续探索 3D 内容的可用性拓展。

当前,Seed3D 2.0 API 服务已上线火山方舟。

几何生成更高精度

空间结构推理能力进一步提升

在 3D 生成中,白模常常被用于确定精准几何结构,为精细纹理生成和实际生产落地奠定基础。然而,3D 生成的白模往往存在几何质量不稳定的问题,如噪点、烂面、倒角模糊、结构错乱等情况,用户往往需要花数小时修模才能使用。

Seed3D 2.0 生成的白模完整保留物体的结构细节,倒角边缘清晰锐利,精准还原目标物体的结构特征。

这一改进得益于几何生成架构的重新设计。Seed3D 2.0 采用 Coarse-to-Fine 两阶段策略,将「整体结构」和「几何细节」解耦:阶段一先由大参数 DiT 基于输入图像生成粗粒度几何,建立整体的拓扑关系和空间布局;阶段二以阶段一的输出作为几何锚点,专注于锐利边缘和精细表面的恢复。

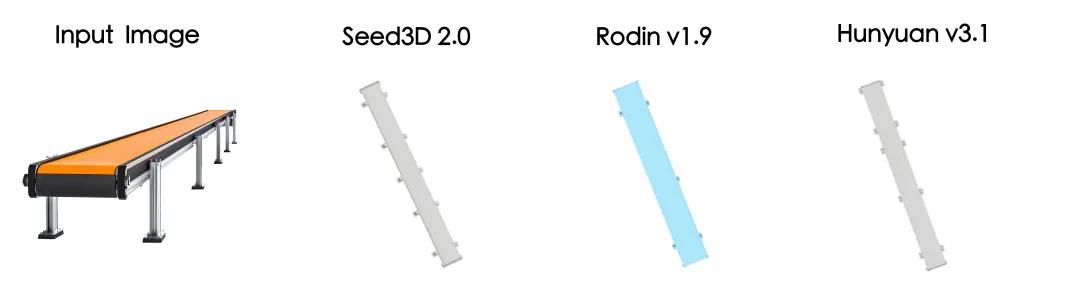

如下图所示,与现有主流 3D 生成模型的定性对比表明,Seed3D 2.0 在处理复杂结构的精细边缘、生成薄壁结构和还原输入图像方面明显优于基线方法。

几何生成维度的定性对比

此外,Seed3D 2.0 在空间结构理解上也有较好表现,可以基于有限的视觉信息,推断出物体的完整三维结构。

以一张工业传送带的示意图为例,Seed3D 2.0 不仅还原了传送带主体,还推断出下方支撑腿的排列方式、整体的长宽比例、以及各组件之间的连接关系,生成结果在结构逻辑上与原图保持一致。

纹理材质生成更精细

可直接进入标准渲染与生产流程

此前 3D 生成模型在材质环节存在几个典型问题:文字和符号容易出现模糊、变形、乱码;金属与塑料的质感难以区分;真实物体的光学属性难以精确还原。

Seed3D 2.0 对材质生成架构做了系统性调整,带来了几个关键维度上的能力提升:文字与符号的还原精度提升,可支持产品铭牌、包装、logo 等对文字清晰度要求较高的场景;支持多层级、多类型的复杂材质组合,能够准确区分金属、塑料、陶瓷、织物等不同材质的物理属性差异;输出完整的 PBR 材质贴图,使得 3D 资产在不同光照条件下保持物理一致的视觉表现,产物可直接接入标准渲染管线。

更灵活的组件生成

面向仿真和具身场景的探索

在具身智能训练、仿真环境搭建等下游场景中,3D 资产需要支持物理交互,而不只是静态展示。

后续,Seed3D 2.0 将支持把完整 3D 资产按功能拆分为独立部件,并为部件添加关节信息,适配铰链结构的旋转、抽屉的推拉、机器人关节的多自由度活动等物理运动,可用于机器人抓取等动态交互仿真任务的资产构建。输出结果经处理后,将兼容 Isaac Sim 等主流物理仿真引擎,减少传统流程中物理属性绑定和结构优化的人工成本。

在场景层面,模型未来也将支持文本、多视角图片或视频等多种输入,并组合多个 3D 资产生成完整场景。

高质量、可用的 3D 资产,正在成为具身智能、工业制造、数字孪生等场景加速落地的重要基础。从几何生成到材质表达,再到面向仿真等下游流程的持续探索,Seed3D 2.0 正在推动 3D 生成更快走向生产可用。

来源:互联网