把复杂的操作和沟通环节,整合成一个可以直接的「交付结果」。

上周,我在深圳参加了一场华为乾崑的媒体日活动。在活动上,华为智能汽车解决方案 BU CEO 靳玉志分享了过去一年华为乾崑的一系列用户和市场数据。

其实,提到华为乾崑,大众第一时间可能会更多想到的是「乾崑智驾」。有几个数据让我印象很深刻:

第一,去年累计使用辅助泊车超过了 3.3 亿次,按 100 万车主推算,平均每个用户一年使用超过了 300 次,真正成为了「每日高频」的功能;

第二,按照华为最近发布的《安全出行报告》,ADS 辅助驾驶平均的安全行程里程数,比全国平均值高出了 3.58 倍。

在辅助驾驶越来越好用的前提下,用户也就对车内的座舱智能度提出了更高的期待。或者说,用户期待汽车可以真正由「交通工具」转换为「出行空间」。

所以,华为也在 2025 年推出了第五代鸿蒙座舱 Harmony Space 5。它基于 MoLA(混合大模型 Agent)架构打造,目标是拓展出更多智能的场景。

众所周知,智能座舱在大众市场里仍然是个「新东西」。由于其全新的交互界面(从实体键为主到屏幕为主)以及交互方式(语音交互为主),所以对很多下沉市场的新用户仍然有一定的学习成本。

媒体日结束后,我也有机会体验到了鸿蒙座舱 HarmonySpace 5 的全新智能化功能。以下是几个具体案例:

1、导航更有「活人感」:

现实生活中,很多时候车内的导航指令可能是「边说边想」或者「七嘴八舌」讨论的。鸿蒙座舱5 支持纠错、改口、接嘴等功能,当我在车内告诉智能助手「去机场」的时候,我可以改口说「去广州(隔壁城市)的机场」;或者更改因为普通话不标准造成的识别错误(「听错了」),而不需要重新唤起、反复交代。

所以,我感觉和智能助手之间的沟通就更像是和真人(出租车、网约车司机)之间的沟通逻辑:沟通、更改、讨论、确认,而不再是和一台不够聪明的机器反复纠结了。

2、小助手变得「更聪明,会来事」了

有一个细节是,在设置好导航地点后,我告诉智能助手「我困了,顺路找家咖啡馆」。一开始我只是期待它可以实现添加途经点的功能,没想到在此场景上,小艺居然自动帮我打开了座椅按摩。

在其他场景下,智能助手也可以听懂很多模糊指令。例如,你可以在窄路会车的时候告诉它「收起车耳朵」,或者在正午阳光太强的时候告诉它「把头顶的帘子拉上」。以往,你往往要正确地说出「后视镜」、「遮阳帘」这类准确的专有名词。

3、打通车内各项应用间生态

鸿蒙座舱5 在娱乐方面的提升也很明显,核心关键词我认为是「整合」。

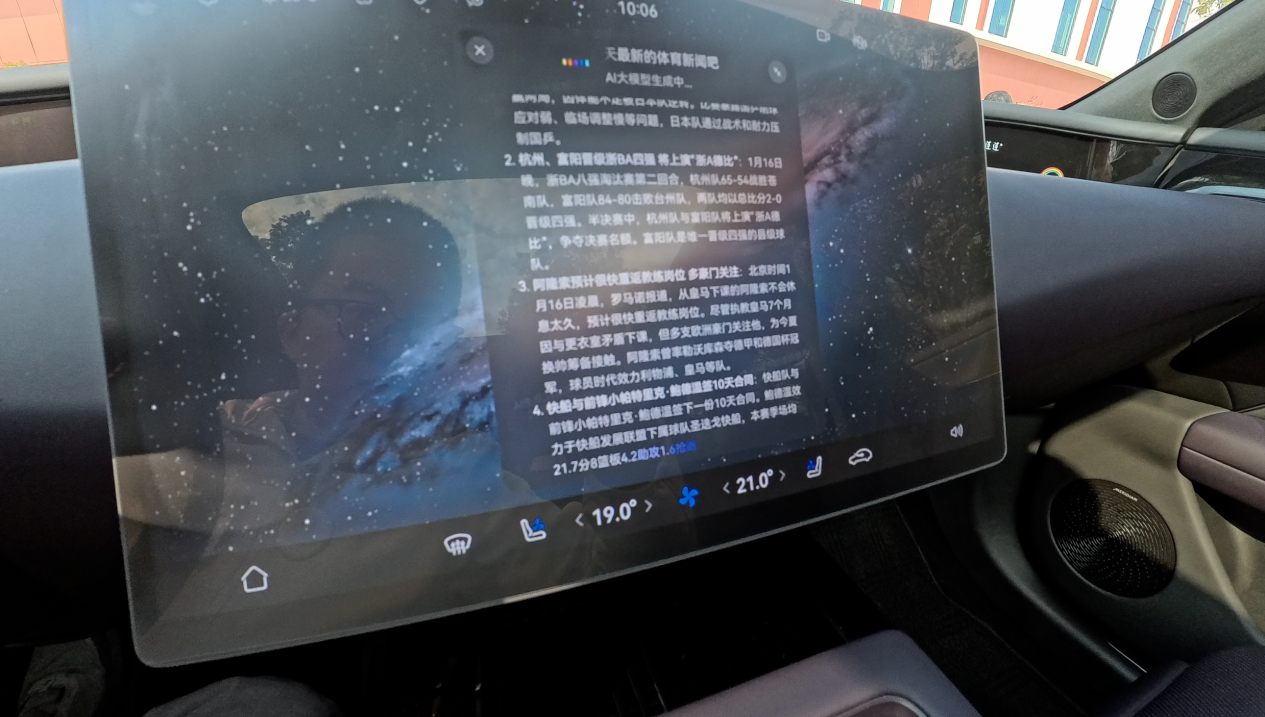

例如,当你提出「为我播报一下今天的体育新闻」时,无需打开任何资讯类 App,系统就会自动生成包括图文、短视频在内的新闻简报供用户挑选。

或者,当你在午休时想听某首歌或想看一部剧时,可以通过描述主演、剧情、歌词的方式,让智能 Agent 自动为你检索且直接打开对应的 App 播放。搭载 MoLA 的鸿蒙座舱5 在娱乐层面把过往搜索、下载 App、找到平台等几个动作进行了合并,直接交付了一个用户真正需要的最终结果。

最后,简单总结一下鸿蒙座舱 HarmonySpace 5 的整体体验和思路:通过整合大模型、Agent 的能力,大幅降低了智能座舱的学习成本;同时,把过去复杂的操作和沟通环节,尽可能整合成一个直接的「交付结果」。

相信,在这个思路下,2026 年鸿蒙座舱的使用频率和场景也会有更多的想象空间。