构建一个从技术、商业到硬件的自主生态闭环。

头图来源:视觉中国

紧随 DeepSeek 的更新,9月30日,在国内「十一」假期前的最后一个工作日,智谱AI发布了其最强代码coding模型GLM-4.6(较4.5提升27%) 。

与前代产品相比,GLM-4.6的发布传递出三个明确的信号:一是在技术上集中资源,将代码生成(Coding)能力作为核心突破口;二是在商业模式上,深化开源与商业化并行的策略,并正式推出面向大型组织的企业级方案;三是在产业生态上,首次披露了与寒武纪、摩尔线程等国产AI芯片厂商的深度适配,意图打通底层硬件到上层模型的自主生态。

在性能迭代的同时,智谱这次试图在激烈的市场竞争格局中,围绕技术应用、商业落地和产业协同进行一次关键卡位。

一、核心技术点:以Coding能力对标全球顶尖模型

在通用能力逐渐趋同的大模型赛道,选择一个足够深、足够有价值的垂直领域进行投入,是建立技术壁垒的关键。

智谱的选择非常明确:Coding。GLM-4.6几乎所有的核心升级,都围绕着代码这一核心能力展开。

根据智谱官方信息,其目标是成为「国内最强的Coding模型」,并在性能上直接对标Anthropic的Claude Sonnet 4 。

为支撑这一目标,智谱公布了两个维度的数据:

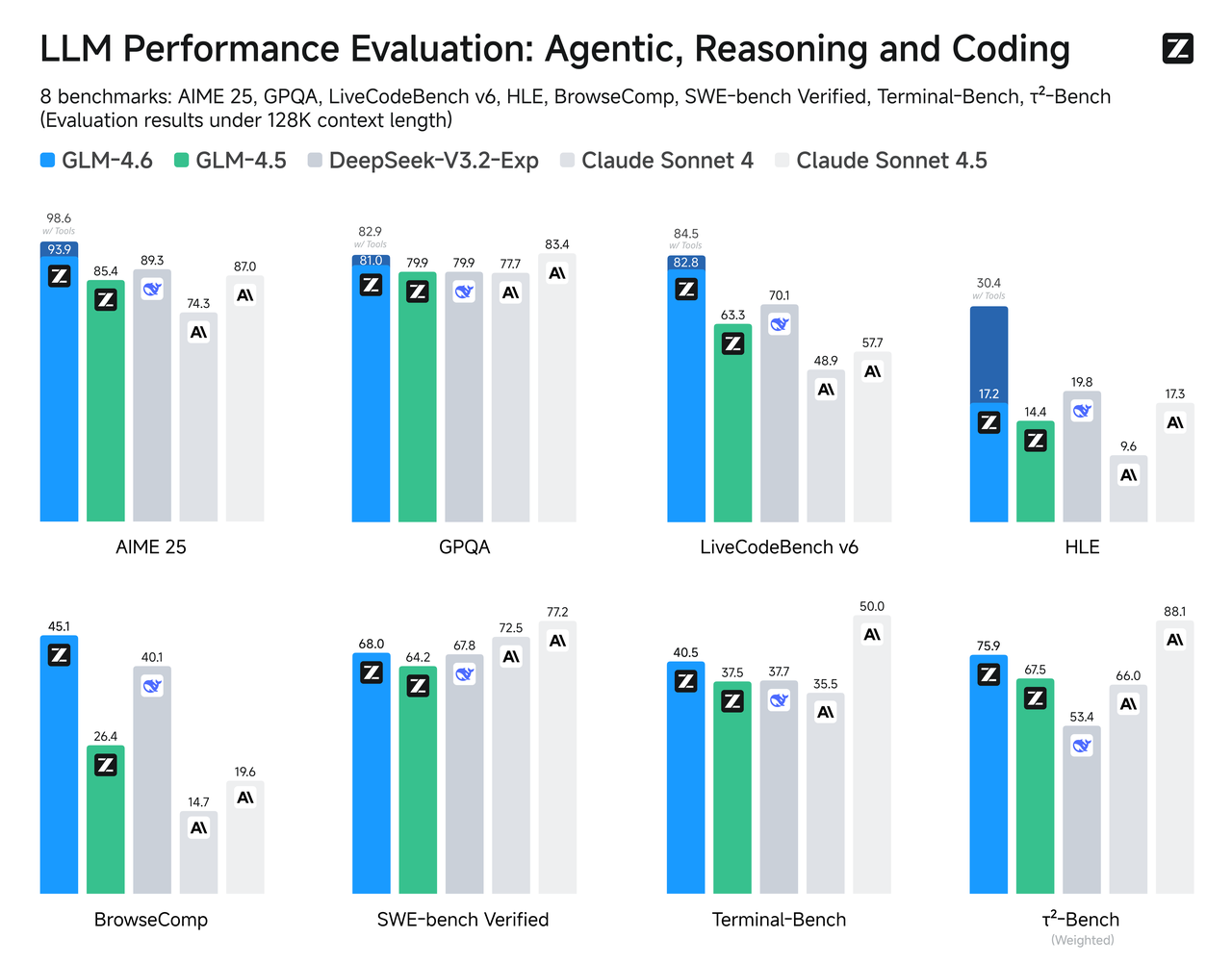

- 公开基准测试(Public Benchmarks):在AIME 25、GPQA、SWE-Bench Verified等8个行业公认的权威基准测试中,GLM-4.6在多数榜单上的表现与Claude Sonnet 4持平,并领先于其他国产模型 。这构成了其性能对标的理论基础。

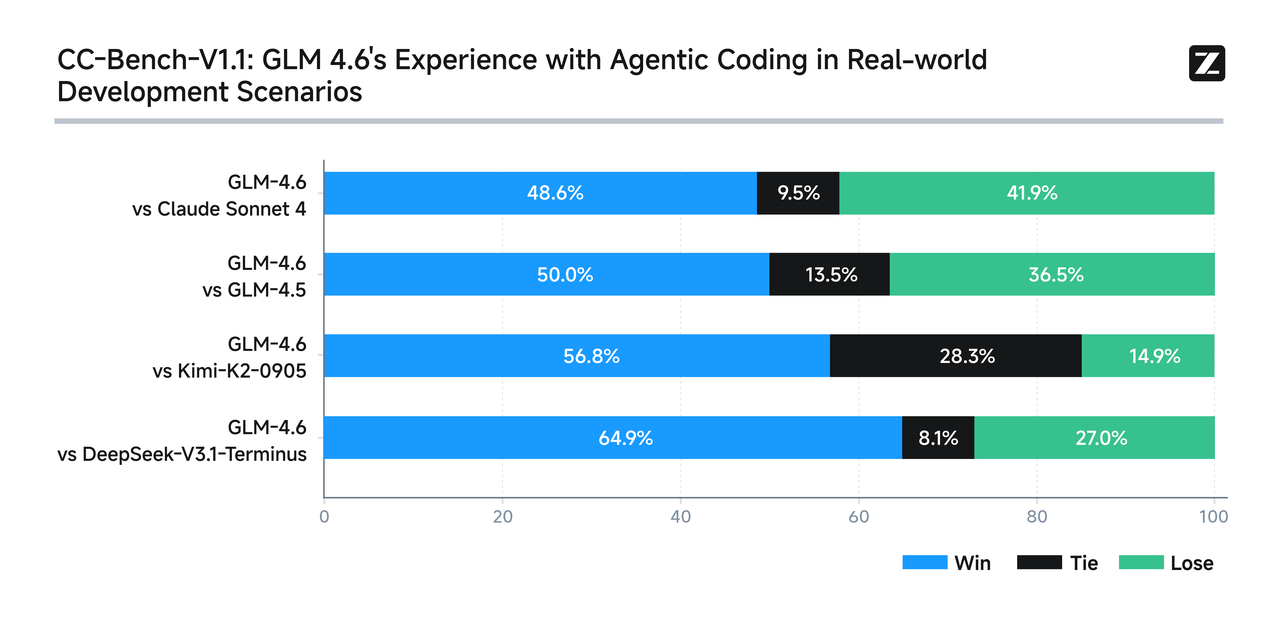

- 真实场景评测(Real-World Evaluation):智谱方面强调,为了评估模型在实际开发环境中的表现,他们在Claude Code环境中构建了包含74个真实编程任务的测试集(CC-Bench-V1.1)。测试结果显示,GLM-4.6在与多个主流模型的「头对头」比较中胜率较高:

GLM-4.6强调的核心能力是「Agentic Coding」 。这是指模型作为智能体(Agent),能够理解复杂任务、拆解问题、调用工具(如搜索引擎、代码执行器)并自主完成整个开发流程的能力。

相较于GLM-4.5,新模型在原生Agent体验上有了显著提升,尤其体现在PPT的可用性、前端代码的美观度以及更先进的版面布局上 。上下文窗口长度从128K扩展到200K ,也正是为了适应更长的代码和更复杂的智能体任务 。

除了性能,智谱还强调了模型的经济性。性能是吸引开发者的第一要素,成本和效率则是决定他们是否长期留存的关键。

官方数据显示,在处理同类任务时,GLM-4.6的平均token消耗比上一代GLM-4.5降低了30%以上,在同类模型中具备成本优势 。

将代码能力作为战略重点,与该领域清晰的商业化路径有关。

代码生成是AI赋能生产力的直接体现,其主要用户——开发者,是构建更广泛AI应用生态的核心群体。

智谱上一代模型GLM-4.5的商业化增长(API调用增长超10倍)已初步验证了这条路径的可行性 。因此,GLM-4.6选择在这一方向上持续投入,意在巩固并扩大其在开发者和企业级市场的优势。

二、商业模式深化:开源与企业级服务的双轨并行

强大的技术能力需要匹配成熟的商业模式才能转化为市场领导力。

在将技术推向市场的方式上,GLM-4.6延续并深化了智谱「开源+商业化」并行的双轨模式。

一方面,继续拥抱开源社区。智谱承诺GLM-4.6将在Hugging Face和ModelScope上开源,并遵循MIT协议 。

此举旨在降低开发者使用和研究的门槛,通过社区的力量加速模型生态的构建和技术普及,这在全球AI技术竞争中是争取开发者和行业标准话语权的重要手段。

另一方面,商业化路径更为精细。

个人开发者层面来看,智谱升级了原有的「GLM Coding Plan」,这是一个按月付费的订阅服务 。

智谱称用户能够以「1/7价格享受到Claude的9/10智商」,并将套餐的入门价格定在了最低20元/月。

升级后,该套餐将自动搭载GLM-4.6模型,并增加了图像识别、搜索以及对超过10种主流编程工具的支持 。此外,还针对高用量开发者推出了用量更大的「GLM Coding Max」版本 ,提供三倍于Claude Max (20x) plan的用量 。

企业级层面而言,此次一个重要的更新是正式推出「GLM Coding Plan企业版」 。

该版本的设计考虑到企业在应用AI技术时的核心顾虑,提供了包括数据安全(承诺企业数据不用于模型训练)、成员套餐批量管理、用量监控分析以及企业专属售后支持等功能 。

套餐从30人起购,并根据购买人数设置了阶梯折扣:满50人享9折,满100人享8折,500人以上则有更高折扣 。

这表明智谱的商业化目标正从吸引个人开发者,扩展到为大型企业提供更体系化的解决方案。

这种双轨模式试图在扩大技术影响力(开源)和实现商业回报(付费服务)之间找到平衡,通过免费和低价的个人套餐吸引海量用户,再通过功能更完善、服务更深入的企业版实现价值变现。

三、产业生态布局:与国产芯片的协同进入实践阶段/构建从芯片到模型的自主生态

这次更新发布中,一个超越模型本身、更具产业风向标意义的信息是GLM-4.6与国产AI芯片的适配进展 。

智谱表示,GLM-4.6已分别在寒武纪和摩尔线程的芯片产品上完成深度适配和部署 。这涉及到了更底层的技术优化:

与寒武纪的合作,实现了FP8+Int4混合量化推理部署 。这是一种在保证模型精度的同时,大幅降低推理成本的技术方案,旨在为国产芯片大规模运行大模型提供一条兼具性能和成本效益的可行路径 。

与摩尔线程的合作基于vLLM推理框架,使GLM-4.6能在摩尔线程新一代GPU的原生FP8精度下稳定运行,验证了国产GPU在生态兼容性和对前沿AI框架的快速支持能力 。

这一系列合作标志着国产大模型与国产芯片的协同,正从概念走向实践。

在当前全球半导体供应链和技术生态格局下,构建从底层硬件到上层AI模型的全栈自主技术体系,已成为国内科技产业的重要方向。

智谱通过MaaS平台将「国产模型+国产芯片」的组合方案推向市场,不仅是为自身构建差异化的竞争优势,也意在与硬件厂商共同推动自主AI基础设施的成熟,为国内企业提供一个在技术栈上更具自主性的选择。

总体来看,GLM-4.6的发布,是智谱在AI技术进入应用深水区的背景下,进行的一次系统性布局。

它将技术焦点、商业模式和产业生态协同作为一个整体来推进,试图在日益激烈的国内外竞争中,建立起更稳固的护城河。