9 月 17 日,在 2025 年腾讯全球数字生态大会 Agent+Infra 专场,腾讯云副总裁李力宣布腾讯云智算全面升级。

9 月 17 日,在 2025 年腾讯全球数字生态大会 Agent+Infra 专场,腾讯云副总裁李力宣布腾讯云智算全面升级。腾讯云智算面向「更贴近 Agent 的 AI Infra」建立包括 Agent Infra 解决方案 Agent Runtime+云专家服务智能体 Cloud Mate 与全链路安全能力为一体的完整解决方案,帮助 Agentic AI 从「实验室」走向「生产级」。

李力表示,「同源同构」是贯穿腾讯云产品设计与服务能力的核心原则,也是其应对行业需求、面对技术变革、支撑全球化布局的关键逻辑。这一原则包含双重核心内涵:一方面,以一致的代码体系、服务标准与产品特性,同步服务腾讯微信、QQ、游戏等自研业务与外部客户,通过「自用自验」提前解决技术痛点,向行业客户交付成熟的技术与服务;另一方面,实现公有云、专有云、边缘计算、分布式云及国内外服务的能力统一,即便海外开区,机房标准与功能体验也与国内完全一致,保障全球化服务的一致性。

这一云计算时代坚守的原则,在智算领域展现出更大的价值:例如在存储层面,腾讯云凭借十年来打磨的 CBS、CFS 等存储产品,即可完美匹配 AI 对存储的性能需求,而无需推导重构一套适配于智算时代的存储底座。可以说,智算的兴起进一步凸显 AI 原生云的优势。李力强调,「同源同构」是腾讯云 IaaS 体系的核心调性,它不仅是产品技术层面的标准,更是腾讯云在 AI Agent 时代为客户提供稳定服务、支撑全球化拓展的底层逻辑,也为客户降低跨场景、跨区域的技术适配成本。

他认为,与 AI 时代相比,Agent 时代对 Infra 的需求出现了全新的变化。未来两年,部署 AI Agent 的企业数量将翻番,相关支出增幅将达到 192%。按照行业惯例,云基础设施的建设支出,将会比 AI Agent 的支出更大。大量企业将会提前投资、储备云基础设施,已适配业务需求的重大变化。但部分企业仓促落地的智算中心,往往采购大量高端硬件设备,但却因为配套设施(存储、网络、安全、运维等)建设上的之后,陷入闲置风险。这不仅导致成本与时间的巨大消耗,也会导致错失关键市场窗口期。

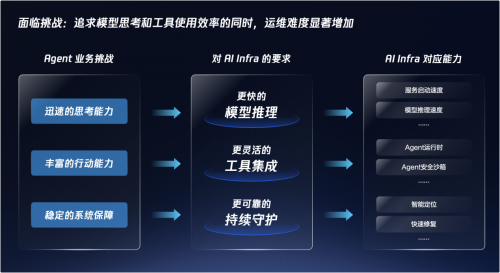

要解决这个现状,就需要注意到 AI Agent 时代对 Infra 提出的新要求。一是更快的模型推理效率。这意味着除了提供「又快又稳」的底层能力之外,Infra 还需要具备更贴近业务、从底层「向上」辐射的价值。为了让模型推理更快,可以基于云的角度去做一些探索,在 Infra 底层技术和工程创新上帮助 AI 落地更加顺畅。二是更灵活的工具集成。实际上在部署和运行 Agent 的过程中,Agent 本身就是一个工具,能调用哪些工具,是否好用也没有明确的目标。但最终的目的,是像人的手脚一样,能够形成工具的集合,在一个工具自动运行的时候,其他工具能够协同辅助,让 Agent 延展的更广,得以体现它的智能优势。三是稳定的系统保障。在通用计算场景下,业务和底座是分离的。但到了智算时代推理阶段,模型和业务天然绑定在一起。假设企业的核心业务已经在云上跑,要把它迁移到智算平台,那就会对存储、网络、中间件提出巨大挑战,对平台的系统保障提出了非常高的要求。

针对智算时代的新需求、新挑战,腾讯云智算提出要成为「更贴近 Agent 的智能引擎」。它包括 AI Infra 灵活底座+AI Infra 多元硬件、AIinfra 高性能软件,以及全新升级发布的 Agent Infra 解决方案「Aggent Runtime」、云专家服务智能体「Cloud Mate」以及全链路安全能力。

在底座上,腾讯云智算持续进行优化提升,成为更贴近 Agent 的 AI 原生云。在硬件层面,支持一云多芯、软硬协同,支持多样硬件生态,支持自研及第三方交换机;在软件层面,提供大语言模型加速(TACO-LLM 推理效率提升 100~130%)、文生图模型加速(TACO-DIT 推理效率提升 122%)、推理集群即服务(HAI 分钟级拉起满血模型,高缓存命中)等核心升级。他举例说,基础设施的升级能够显著影响客户体验。例如在游戏场景频繁扩缩容、或者终端厂商提供模型服务切换底层模型的场景,都高度依赖云平台的扩缩容速度。而腾讯云历史上沉淀的创建速度快的优势,在智算时代继续成为了客户认可的禀赋。

在模型推理层面,腾讯云智算高性能软件的升级,能够助力推理集群性能发挥到极致。一方面,实现模型启动效率的飞跃——依托 HML 去中心化加速模型拉取、RDMA 高速网络与 GooseFS 等,大规模扩容场景下整体服务拉起时间从 10 分钟大幅压缩至 34 秒,模型启动速度提升 17 倍,让 AI 服务能像消费电子设备般「即开即响应」;另一方面,在多模态推理加速上实现突破:腾讯自研的 TACOKit 推理加速引擎,通过文生图并行化处理等技术,使生文、生图、生视频模型,在大部分场景下性能提升 4 倍以上,有力支撑客户海量图像生产、快速创意迭代的需求。借助全局共享 KV 缓存、TRMT 通讯协议、PD 分离部署、模型量化等底层技术优化,客户无需额外适配,就能获得极致推理速度,大幅降低 AI 推理能力落地的技术门槛。

在工具集成层面,腾讯云智算全新发布 Agent Runtime 云沙箱,为 Agent 提供安全隔离的执行环境。Agent Runtime 脱胎于腾讯云原生已有的体系,实现 Infra 服务的极致无缝化。它能快速创建运行环境,支撑大规模 Agent 应用落地;它将基建运维做到「极致无感」,用户无需关注底层资源调度逻辑,计算资源会按需「凭空出现」,完成任务后自动释放,全程无需手动开关机或配置环境。

在系统守护方面,腾讯云智算发布 Cloud Mate 云专家服务智能体,基础设施向主动服务跃进。李力说,AI 让 Infra 变得更智能,更可靠,具备「主动服务」的特性。Cloud Mate 云专家服务智能体以实时监控、操作审计、资源配置、日志等基础能力为底座,结合预测与诊断模型,再通过自动化执行工具,构建起「源头风险预防-运营风险规避-智能运维」的全链路主动服务能力。一方面,能对云环境中 SQL 性能瓶颈、潜在安全漏洞等进行智能预判与精准诊断提前拦截高峰扩容等场景下的隐性风险;另一方面,借助 AI 从海量日志中自发挖掘潜在问题并推动专家响应,让海量服务器与算力资源的管理更可控、更智能。在实践中,Cloud Mate 已经能够实现 3 分钟快速诊断,准确率超过 95%。

机器人正在成为 AI 发展落地的重要方向,但具身智能也面临着显著挑战。一方面,具身智能缺乏大语言模型所具备的天然、开放、海量的数据,而具身数据和硬件高度绑定,对数据质量的要求极高;另一方面具身智能依赖的多模态感知,需要整合图像、文字、声音甚至触感等多元信息,实现综合交互的作用。腾讯依云通过 HAI 推理集群联合自研具身智能产品 Tairos,提供具身感知与规划模型服务,以「多模态、全托管、独享算力、安全稳定」为核心特性,为机械臂、人形机器人等设备打造专属、跨本体的「云上大脑」。

李力介绍说,腾讯云智算还在通过一些基于 AI 的特性解决开发领域中的一些难题。推出 OrcaTerm AI 原生智能终端,以 AI 整合服务器环境信息为核心,支持脚本生成、应用部署、业务排障等全流程操作,让服务器「带内」操作如自然对话般简单。这个探索产品上线后,很快就实现了数万日活、用户平均停留数个小时的好成绩。在轻量云服务器等产品探索 AI 化服务,解决传统海量文档对用户的过度消耗。

李力表示,目前,腾讯云智算已经服务了国内 90% 的大模型厂商,并为交通出行、工业制造、教育培训、具身智能、医疗健康、金融保险等千行百业提供了高效、好用的云智算解决方案。腾讯云希望,通过 Infra 让 AI 变得更好,也通过 AI 让 Infra 变得更好。

来源:互联网