6 月 11 日-15 日,2025 国际计算机视觉与模式识别会议(Conference on Computer Vision and Pattern Recognition 2025,简称 CVPR2025)在美国田纳西州召开。

6 月 11 日-15 日,2025 国际计算机视觉与模式识别会议(Conference on Computer Vision and Pattern Recognition 2025,简称 CVPR2025)在美国田纳西州召开。值得买科技与中国人民大学高瓴人工智能学院在多模态领域的最新联合研究成果《图像转有声视频》(《Animate and Sound an Image》)成功入选 CVPR2025 会议。

此次成果首次提出了一种从静态图像直接生成同步音视频内容的生成框架——JointDiT(Joint Diffusion Transformer),实现了从图像到「动态视频+声音」的高质量联合生成。据悉,此次研究成果是继去年双方发布《TiVA:Time-aligned Video-to-Audio Generation》《BSharedRAG:Backbone Shared Retrieval-Augmented Generation for the E-commerce Domain》《MuKA:Multimodal Knowledge Augmented Visual Information-Seeking》后的又一创新探索,不仅展现了值得买科技在 AIGC 方面的技术创新突破,更为 AI 多模态的高质量发展提供了新的思路与启发。

CVPR 是由 IEEE(电气电子工程师学会 the Institute of Electrical and Electronics Engineers)与 CVF(计算机视觉基金会 Computer Vision Foundation)联合主办的计算机视觉和模式识别领域的顶级年度会议,每年吸引来自学术界、工业界和政府部门的数千名与会者,展示、学习和交流视觉技术的最新创新成果。CVPR2025 涵盖了从基础计算机视觉理论到自动驾驶、医学成像和生成式人工智能等领域前沿应用的方方面面,被录用的论文代表了该领域最具影响力且经过严格同行评审的研究成果,以此引领技术潮流。

值得买科技与中国人民大学人大高瓴人工智能学院联合开展的 AIGC 研究自 2023 年 6 月发起,结合值得买科技的集群算力、消费数据和应用场景能力,以及人大高瓴的科研和人才能力,在 AI 内容创作、多模态生成等方面共同开展 AI 前沿研究,加速技术探索和应用。

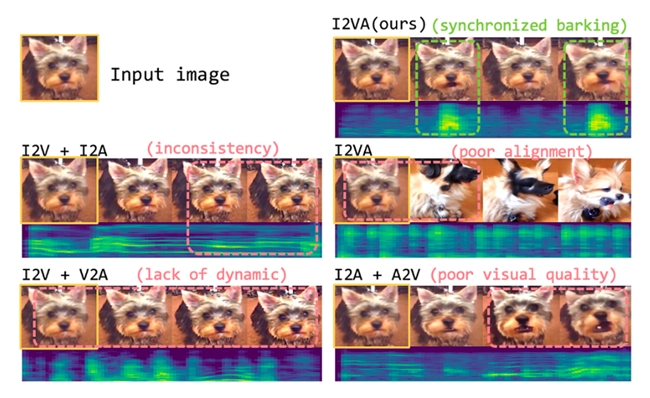

人大高瓴人工智能学院王希华表示,长期以来,生成式模型的研究主要在单一模态的内容合成上,也取得了显著进展,探索了各种模型架构、生成范式以及扩展性特性等,以提升视频或音频的质量,如生成高保真的视频画面或自然的音频片段。但模型在生成自然融合的有声视频时却存在明显不足,视频和音频分离的生成过程,往往导致画面和声音语义不匹配或者时间上不同步,目前将两个模态联合生成自然有声视频的研究,缺乏对统一建模机制的探索。

基于此,此次的联合创新成果《图像转有声视频》(《Animate and Sound an Image》)首次提出并系统定义了图像到有声视频生成(Image-to-Sounding-Video,I2SV)这一新任务:让静态图像「动」起来的同时,生成与之语义匹配、时间同步的音频内容。同时,这一成果还提出了一种新颖的内容生成框架 JointDiT(Joint Diffusion Transformer),并具体阐述了如何利用两个强大的单模态预训练扩散模型(一个视频生成器,一个音频生成器),构建统一的联合生成框架,并实现多模态协同生成。

JointDiT 不仅采用了「重组+协同」的创新思路,构建高效的图像转声音视频模型,实现了真正协同的多模态生成,创新性地实现了从一张图片直接生成同步音视频内容;还设计了感知式联合注意力机制(Perceiver Joint Attention),使用模态特定的 Query-Key-Value 映射,实现对视频帧与音频序列之间的细粒度互动建模,有效提升同步与语义一致性;同时提出联合无分类器引导(JointCFG)及其增强版 JointCFG*,在保留图像条件引导对齐的同时,强化了模型对跨模态之间交互的关注,进而提升了音视频之间的语义一致性与时间同步性,该策略不仅优化了生成质量,还显著增强了视频的动态表现力。

研究团队在三个标准数据集(AVSync15、Landscape 和 GreatestHits)上进行了大量测试,从视频质量、音频质量、同步性和语义一致性四个维度全面评估。

结果显示,JointDiT 在视频质量与音频自然度方面均实现显著提升,FVD、FAD 等核心指标全面优于基于 pipeline 组合的多阶段方法。音视频同步性表现优异,在自动评价指标上与当前最强的音频驱动视频生成模型持平。语义匹配也更为精准,视频画面与声音的「含义」更加契合。在用户主观打分测试中,JointDiT 在「视频质量」「音频质量」「语义一致性」「同步性」与「整体效果」五项评分中均排名第一,领先第二名近 20%。

人大高瓴人工智能学院长聘副教授宋睿华表示:「接下来,研究团队计划将 JointDiT 扩展至图像、文本、音频、视频四模态的联合建模,为构建更通用、更智能的多模态生成系统奠定基础。」

作为一家 AI 与内容驱动的数字消费服务集团,值得买科技在发展的不同阶段,都注重用先进技术来驱动业务发展,因此在 AI 浪潮来临之时就抢先布局,早在 2023 年就将 AIGC 列为集团重点战略项目,在 2024 年发布全面 AI 战略,并开启了一场全面的 AI 探索与革新。其中,与学术界合作共同进行 AI 前沿探索,也是值得买科技全面 AI 战略中的重要一环。据悉,值得买科技与人大高瓴团队正在制定开源计划,让更多开发者可以更便利地应用这一成果。

当前,值得买科技已形成了从技术底层、产品形态到生态共建的全面 AI 布局:不仅构建了以 AIUC 引擎为代表的底层 AI 技术能力;还推出了面向用户、品牌、创作者及大模型的 AI 产品和解决方案,值得一提的是,面向用户的「什么值得买」平台借助 AI 能力在今年 5 月全面升级为「什么值得买」GEN2,「小值」也全面升级为 AI 购物管家「张大妈」。同时,从 2024 年开始,值得买科技还将自身沉淀的 AI 能力开放给合作伙伴,共建高质量 AI 生态,今年更是通过打造值得买科技「海纳」MCP Server,为 AI 生态中的各类应用提供消费领域的能力增强服务,以期成为智能体时代消费领域的基础设施,促进行业生态繁荣。

未来,值得买科技将坚持全面 AI 战略,并将 AI 应用研究作为战略重点,进一步将前沿 AI 技术转化为实际生产力,推动「AI+消费」的更多可能性;同时携手更广泛、更多领域的合作伙伴,共同探索 AI 在学术、技术、商业上的创新和应用,共同推动 AI 生态创新协同发展,为创造人人因消费而幸福的美好世界做出贡献。

来源:互联网