阿里开源千问 3 向量模型,性能提升 40%

6 月 6 日,阿里开源通义千问 3 全新的向量模型系列 Qwen3-Embedding(简称千问 3 向量模型)。该模型以千问 3 为底座,专门为文本表征、检索和排序等核心任务进行优化训练,性能较上一版本可提升 40%,在 MTEB 等权威专项榜单中超越了谷歌、OpenAI 、微软等公司的顶尖模型,揽获同类模型的 SOTA 最佳性能表现。

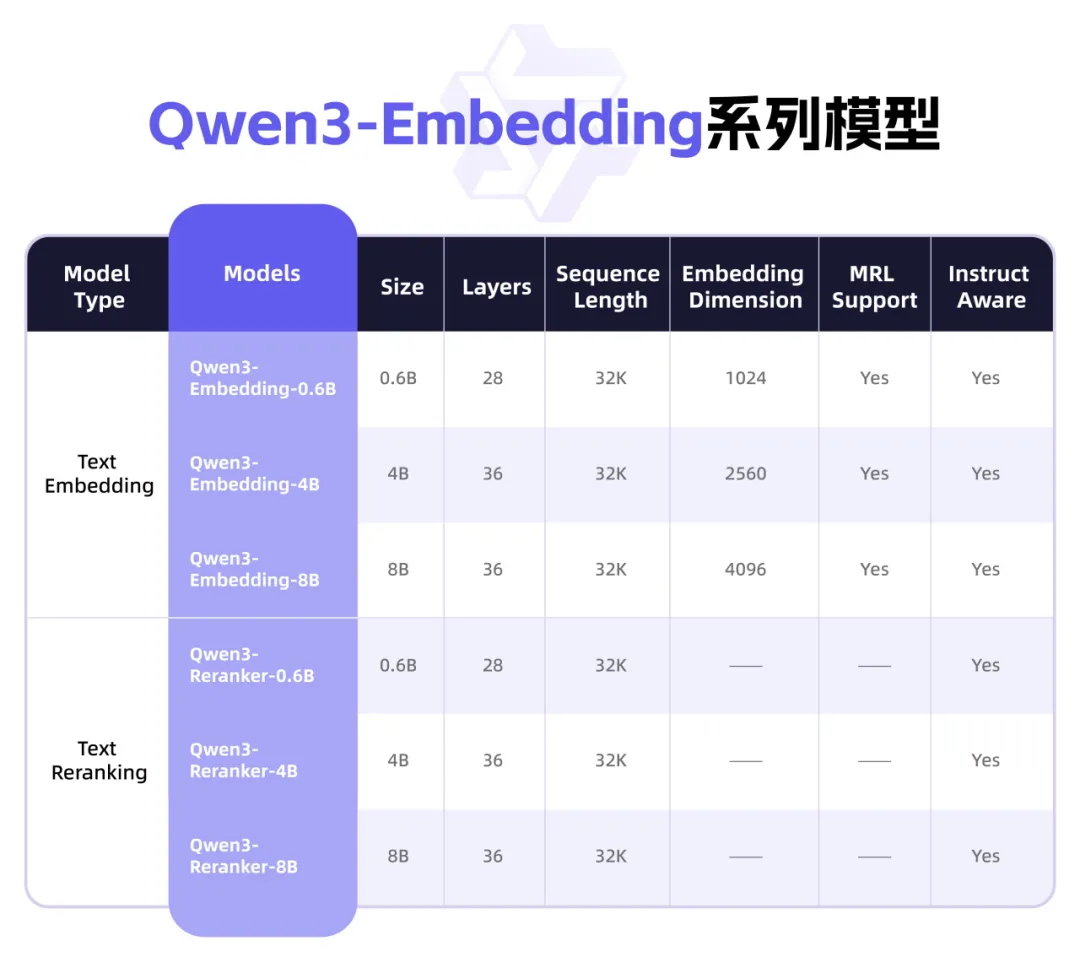

图说:Qwen3-Embedding 系列模型

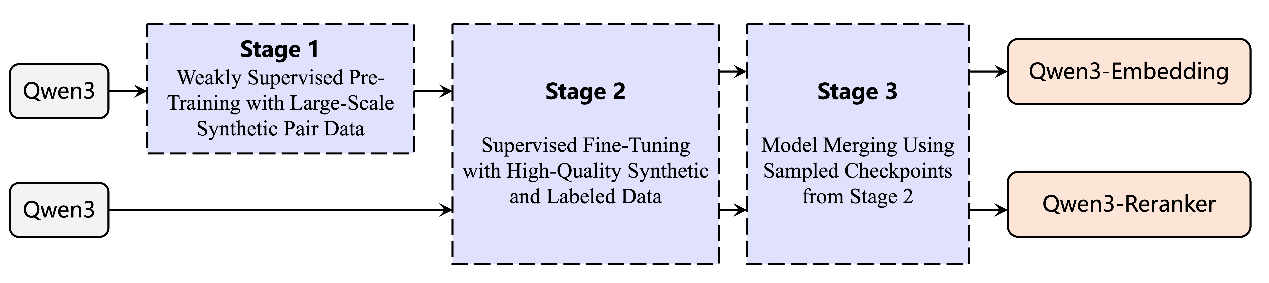

向量模型像是 AI 的「翻译器」,它可以将文本、图片等人类可认知的非结构化信息,映射(embedding)到机器更易理解的向量空间,再基于这些向量实现高效的信息分类、检索或排序。也正因此,向量模型对于提升 AI 的语义理解、信息检索、多模态融合等核心能力至关重要。基于千问 3 模型,通义团队通过对比训练、SFT 、模型融合等方法,打造出全新的千问 3 向量模型,包含文本嵌入模型 Qwen3-Embedding 以及文本排序模型 Qwen3-Reranker。

图说:千问 3 向量模型系列训练过程图

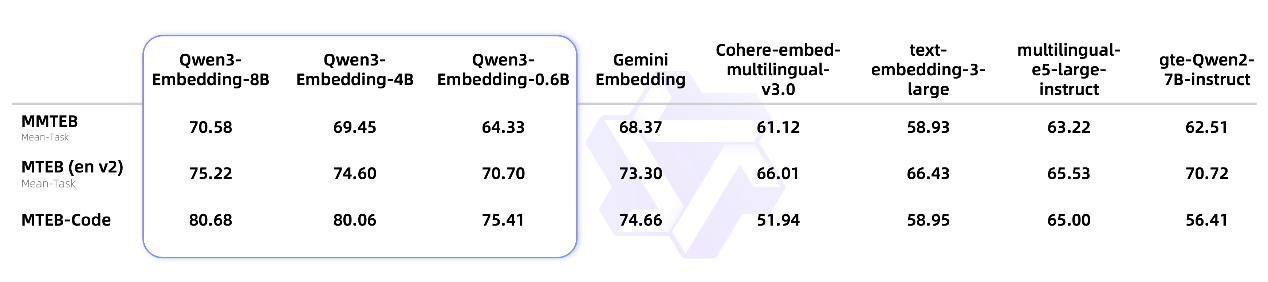

相较于上一个版本,千问 3 向量模型在文本检索、聚类、分类等核心任务上提升最高 40% 以上的性能。在评估向量模型通用能力的 MTEB 多语言排行榜上,Qwen3-Embedding-8B 超越谷歌的 Gemini Embedding 、Open AI 的 text-embedding-3-large 及微软的 multilingual-e5-large-instruct 等顶尖模型,拿下同类模型的最佳性能 SOTA。同时,得益于千问 3 的多语言能力,千问 3 向量模型系列率先支持超 100 种语言,并涵盖多种编程语言,可实现强大的多语言、跨语言及代码检索能力。

图说:千问 3 向量模型在 MTEB 等基准测试中获 SOTA 最佳性能表现

为方便开发者,此次有 9 款千问 3 向量模型开源,涵盖 0.6B 、4B 、8B 等不同尺寸及 GGUF 版本。开发者可从中找到最符合需求的模型,自由组合模块,还可自定义向量或指令,实现特定任务、语言和场景的深度优化。比如,开发者可在智能搜索、推荐系统中采用 Qwen3-Embedding 作文本向量化,或者在 RAG 实践中用 Qwen3-Reranker 提升最终结果的相关性和准确性,甚至与视觉理解模型结合,探索前沿的跨模态语义理解。

目前,千问 3 Embedding 和 Reranker 模型均已在魔搭社区、 Hugging Face 和 GitHub 等平台上开源,开发者也可直接通过阿里云百炼使用 API 服务。据了解,千问 3 大模型自 4 月 29 日开源以来,已揽获 Artificial Analysis 、LiveBench 、LiveCodeBench 、SuperClue 多个国内外权威榜单的全球开源冠军。