当大模型从技术奇点向产业纵深演进,企业正面临 AI 基础设施的多重挑战。

当大模型从技术奇点向产业纵深演进,企业正面临 AI 基础设施的多重挑战:既要通过私有化部署满足数据隐私和安全需求,又要承载百亿、千亿参数规模的澎湃算力;既要应对动态演进的业务需求,又要平衡基础设施的投入成本。

在这场智能革命的发展浪潮中,「EasyStack+DeepSeek」、「云+AI」充满化学反应的组合,不仅是软硬件技术的简单叠加,更是智能时代基础设施与上层应用的深度交响——EasyStack 为用户提供可"弹性生长"的 AI 基础设施架构,让每个企业都能找到专属的智能进化路径。

EasyStack 云基础设施如同具备"生命体征"的数字基座,为 DeepSeek 大模型提供了全维度的进化支撑:从最小 1 个算力节点的轻量化部署,到支撑 671B 超大规模参数的算力承载;从 X86、海光、ARM 等多元算力的灵活调度,到云主机、容器、裸金属等多种部署形态按需选择,企业可以根据算力需求、业务阶段和合规要求,像"拼乐高"般自由构建 AI 基础设施。实现诸如在季度性业务高峰时,部署在 EasyStack AI 基础设施上的 DeepSeek 模型算力资源可以横向扩展,全程业务零中断;或者从 7B 模型起步,随着场景深化逐步扩展至 671B 规模,底层基础设施通过"OTA"实现平滑持续进化。

从芯片到云、到 DeepSeek 再到 AGI 应用均拥抱开源技术,EasyStack 从创办以来一直的理念就是开源生态产品化,拥抱 Linux、OpenStack、Docker、K8S、Ceph 等主流基础架构开源技术打造世界一流体验的云计算产品。开源,在智能时代正在以开放协作的化学反应催生着更深更广的技术革新与进化。EasyStack 作为开源理念的践行者,既是这场革命的参与者,更是开源生态进化规则的先行者,在智能时代持续拥抱开源 DeepSeek 的创新构建 AI 基础设施。

在技术民主化的浪潮中,最具生命力的不是某个"超级大脑",而是让每个智慧个体都能自由连接、共同进化的生态土壤。开源生态,使得从芯片物理层、到 Cloud 和 AI 基础设施层、再到 AGI 认知层的技术进化,不再是封闭实验室里的孤岛实验,而是演变为全球开发者共同参与的"生命工程"。

EasyStack+DeepSeek,这套架构真正实现了"生长型 AI"的核心理念:通过模块化设计的 EasyStack AI 基础设施底座,企业既可在单算力节点上完成 DeepSeek 私有化部署的业务启动,也能通过积木式扩展构建千卡集群;既可以支持 NVIDIA 算力生态,也为国产算力芯片提供了兼容接口;其独有的"无感升级"能力,让底层架构的迭代与上层模型的进化始终同频共振。这种"从 1 到 N"的弹性生长模式,使得 AI 基础设施不再是沉重的成本中心,而是真正具备生命力的价值创造引擎。

EasyStack AI 基础设施并行支撑 DeepSeek/AGI 应用和传统应用

一、EasyStack 渐进式可进化 AI 基础设施

1. 既有 EasyStack 云基础设施平滑实现 DeepSeek 热插拔

对于已经部署 EasyStack 云基础设施的用户,通往私有化部署 DeepSeek 大模型的最短路径早已铺就——无需颠覆既有架构,不必经历数据迁移阵痛,通过"热升级+积木式扩展"的产品能力,即可在现有 EasyStack 云平台上无缝构建 DeepSeek 专属智能引擎。 即使对于已部署的 EasyStack 云基础设施比较早期的版本,用户也可以通过产品平滑无感升级能力,进化到可支持 DeepSeek 私有化部署的最新版本,业务系统全程零感知,而后基于用户所希望的部署算力类型,按需扩展激活 DeepSeek GPU 算力池,实现基于云主机、裸金属容器或者裸金属服务器的 DeepSeek 私有化部署落地,整个过程如同为现有基础设施安装"大模型插件"。

EasyStack 云基础设施可以提供云主机或裸金属容器部署 DeepSeek 推理系统,云主机或裸金属容器按需挂载 GPU 设备,如果单个云主机或裸金属容器性能不够,可以部署多个相同模型的云主机或裸金属容器,通过 EasyStack 云基础设施的负载均衡组件实现性能提升。

EasyStack 云基础设施也可以提供裸金属服务器部署 DeepSeek,用户可以选择通过裸金属服务创建包含 GPU 的裸金属节点,在裸金属节点完成 DeepSeek 的部署。对于单台裸金属服务器来说,如果服务器配置比较高,比如 8 块 H200 GPU,可以支撑部署中大规模的 DeepSeek。当单台裸金属服务器配置不足时,可以部署多个相同 DeepSeek 模型的裸金属服务器,通过 EasyStack 云基础设施的负载均衡组件实现性能提升。如果用户购买了大模型一体机,一体机中假如预安装了操作系统与大模型软件,EasyStack 云基础设施也可以通过裸金属纳管功能管理一体机,同时也可以使用 EasyStack 云基础设施的负载均衡组件、Proton 二层桥接功能接入云内网络实现性能提升与统一网络。

2. 新建 EasyStack AI 基础设施实现 DeepSeek 私有化落地

对于尚未构建 EasyStack 云基础设施的企业,或者希望通过独立建设方式实现 DeepSeek 私有化落地的既有用户,可以通过全新部署的 EasyStack AI 基础设施底座实现 DeepSeek 从 7B 到 671B 参数的灵活承载。该平台通过预置的智能资源池化技术,在初始部署阶段即开箱实现 CPU/GPU 异构算力、分布式存储、高速网络的全栈融合,使 DeepSeek 千亿级大模型可在最短时间内完成从硬件上架到推理服务发布的全流程;与此同时,其开放式架构设计预留了多维业务接口,同一资源池既可运行 DeepSeek 智能引擎,也可并行支撑传统业务应用,真正实现"一池多用"。这种"大模型+多元负载"的共生模式,不仅避免了传统烟囱式建设的资源浪费,更让企业每一份算力投入都转化为可叠加的智能势能。

3. 解锁 DeepSeek 私有化部署的"参数无界 x 架构无界×形态无界"新范式

EasyStack AI 基础设施以"三层视角"定义 DeepSeek 私有化部署边界:在参数维度,平台通过调度引擎,实现从 7B 轻量化推理到 671B 超大规模的全参数规模承载,单集群可运行不同参数规模的 DeepSeek 模型实例;在架构维度,其异构融合架构创新性地打通 x86、海光、ARM 等多种算力生态,在同一套 EasyStack AI 基础设施底座中,用户可以灵活选择 DeepSeek 私有化部署的架构形态;在算力种类维度,平台支持"三位一体"部署模式,可以灵活根据业务算力类型需求,选择通过云主机/裸金属容器/裸金属等不同算力种类承载 DeepSeek,三种形态可根据业务场景自由选择。

这种打破参数、架构、形态三重边界的实践,真正实现了"一套底座,按需选择,多样场景"的智能进化图景。

对于用户而言,DeepSeek 从小到大、成本从低到高渐进式的落地,并随业务发展而不断优化调整是一条推荐路径,EasyStack 通过云主机、物理机/一体机、裸金属容器部署 DeepSeek 来满足用户不同建设场景下的渐进式需求,在这个过程中,用户可以不断理解并用好 DeepSeek 来落地从简单业务到核心业务的过程,EasyStack AI 基础设施平台也不断进化来满足更加多样化的业务需求。

4. 统一 SDN 网络和负载均衡——构筑大模型时代的"神经中枢+智能血管"系统

基于软件定义网络构建的云网络 Proton,不仅为 DeepSeek 大模型提供网络通道保障,还可与 EasyStack AI 基础设施平台承载的其他业务系统实现网络策略统一管理,提升网络资源配置的灵活性、弹性和效率。针对 DeepSeek 从 7B 到 671B 的全谱系模型,平台内置负载均衡组件,通过智能流量算法将请求精准分发至最优计算节点。无论是轻量级 7B 模型,还是 671B 大规模模型,均可通过统一负载均衡组件实现流量智能调度,统一负载均衡组件可统一支持云主机、裸金属容器和裸金属等不同部署形态的 DeepSeek 的负载均衡需求。

5. 智能基座永续进化:OTA 无感升级与基于用户反馈优化的 AI 基础设施

EasyStack AI 基础设施以"进化即服务"为理念,构建了具备生物式新陈代谢能力的智能底座。通过 OTA 进化引擎,平台可像智能手机升级系统般实现 AI 基础设施底座的持续蜕变——当新一代智能调度算法或其他智能组件发布时,管理员仅需一键触发"进化模式",在保障业务零中断的前提下,完成从芯片驱动到平台组件的原子化更新。平台新特性、新功能的开发,以及已有能力的调优,充分吸收用户投产环境的生产实践反馈。EasyStack AI 基础设施将以永不停歇的进化姿态,重新定义智能时代的基础设施底座生命力法则,为用户提供一套"越用越聪明"的有机基础设施。

EasyStack AI 基础设施支撑 DeepSeek 按需参数/按需架构/按需形态部署

二、推荐硬件配置

此为 EasyStack AI 基础设施的基准推荐配置,适用于大多数企业级 AI 推理场景的共性需求。需要特别说明的是,真正的智能基础设施不应止步于标准模板,EasyStack 技术团队基于"场景穿透式设计"方法论,可为用户提供从芯片选型到拓扑设计的契合具体业务场景和需求的推荐配置,欢迎联系 EasyStack,为您量身锻造完全契合业务需求的智能基座。

1. 已有云基础设施扩容推荐配置——DeepSeek 7B/32B/70B/671B(面向推理)

对于已经部署 EasyStack 云基础设施的用户,可以通过平滑升级和扩容的方式,在现有 EasyStack 云平台上无缝构建 DeepSeek 推理运行环境。

对 7B/32B 参数规模的 DeepSeek,可以选择使用云主机算力或裸金属容器算力承载 DeepSeek,在现有云基础设施上扩容最少 1 台配置 GPU 的算力节点即可完成环境构建。

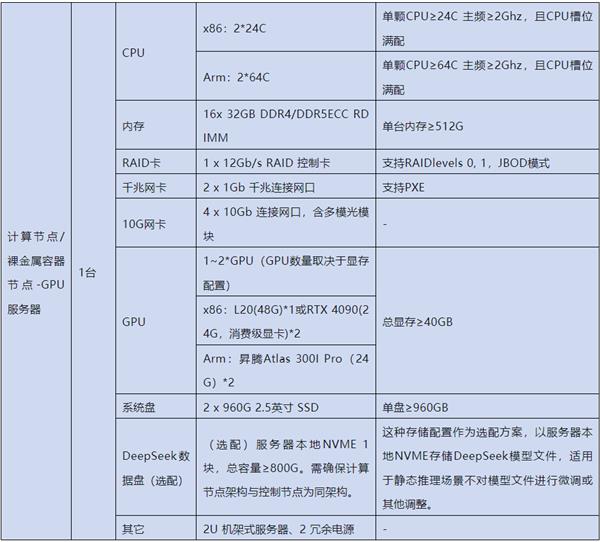

7B 扩容的算力节点推荐配置如下:

32B 扩容的算力节点推荐配置如下:

对 70B/671B 参数规模的 DeepSeek,推荐使用裸金属容器算力承载 DeepSeek,在现有云基础设施上扩容最少 1 台配置 GPU 的算力节点即可完成环境构建。

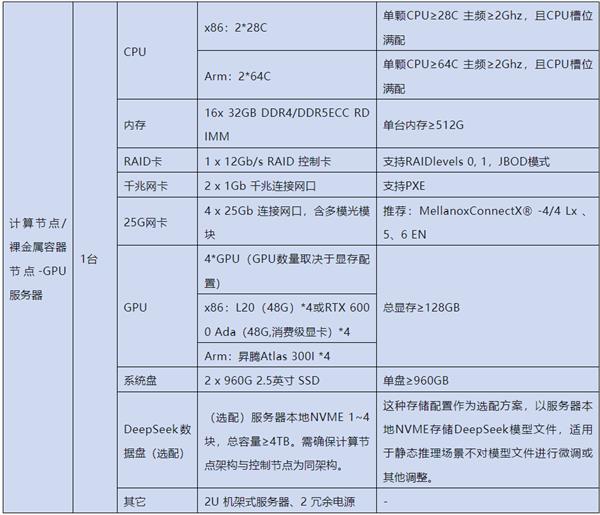

70B 扩容的算力节点推荐配置如下(扩容 1 台或 2 台 GPU 算力节点):

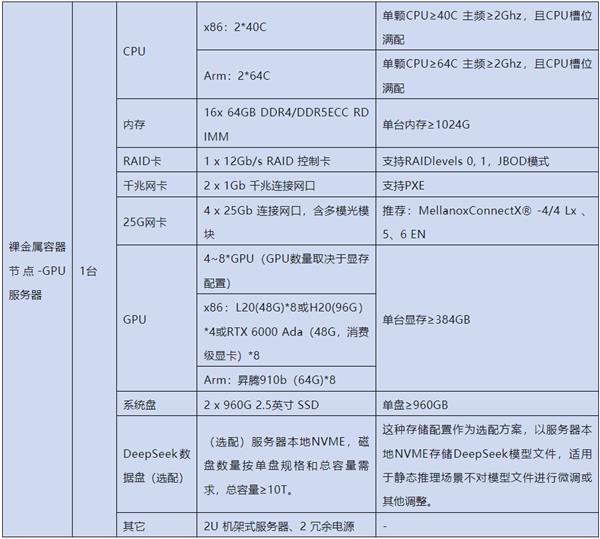

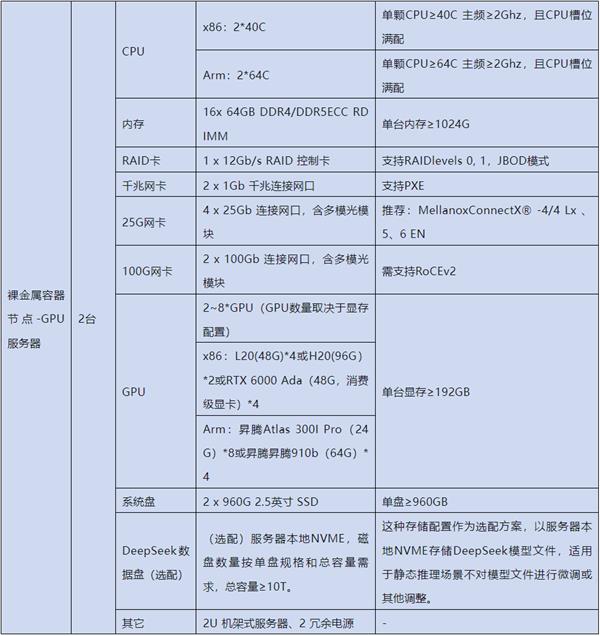

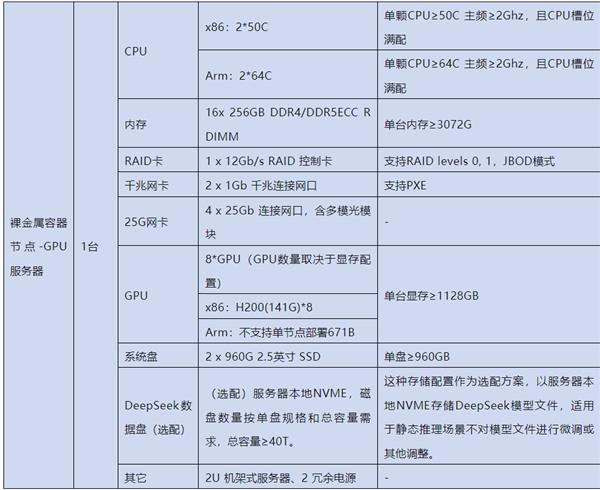

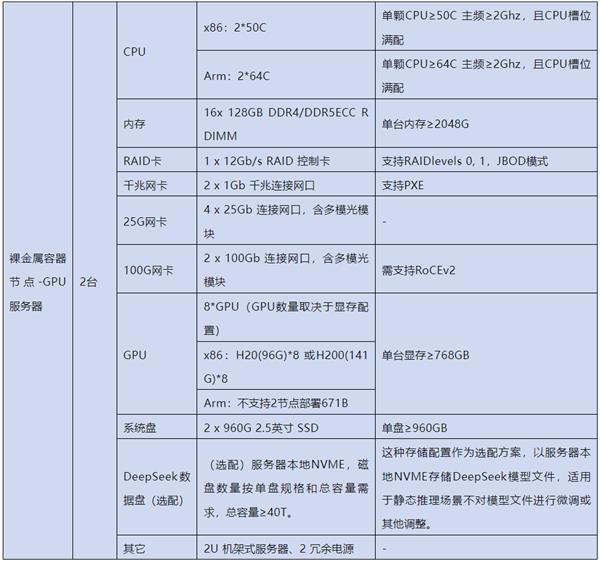

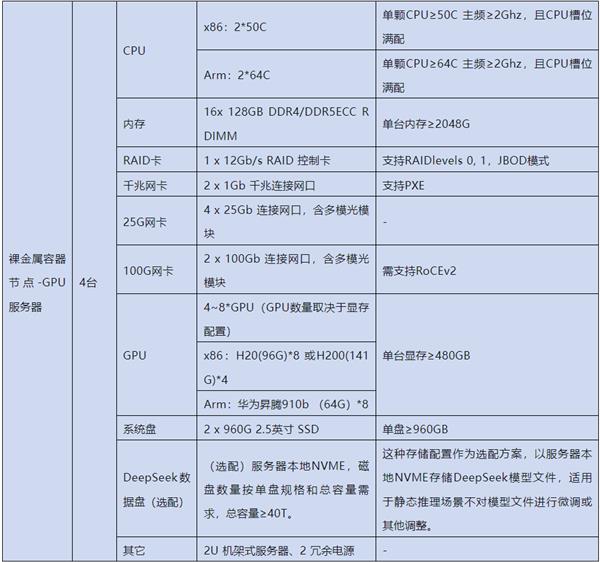

671B 扩容的算力节点推荐配置如下(扩容 1 台、2 台或 4 台 GPU 算力节点):

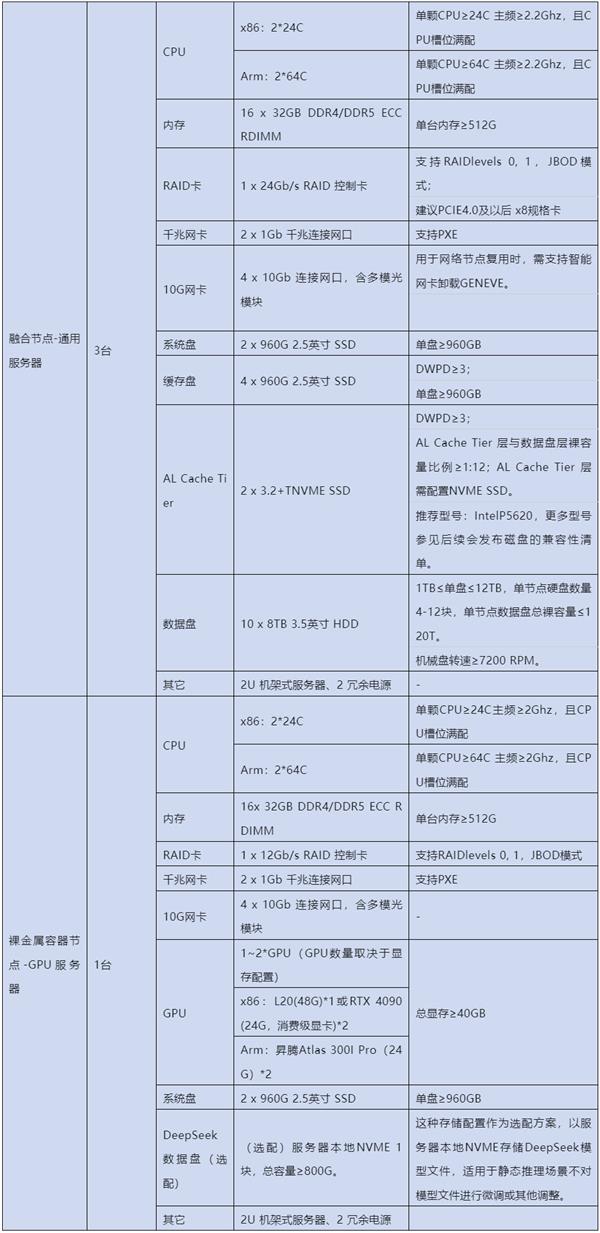

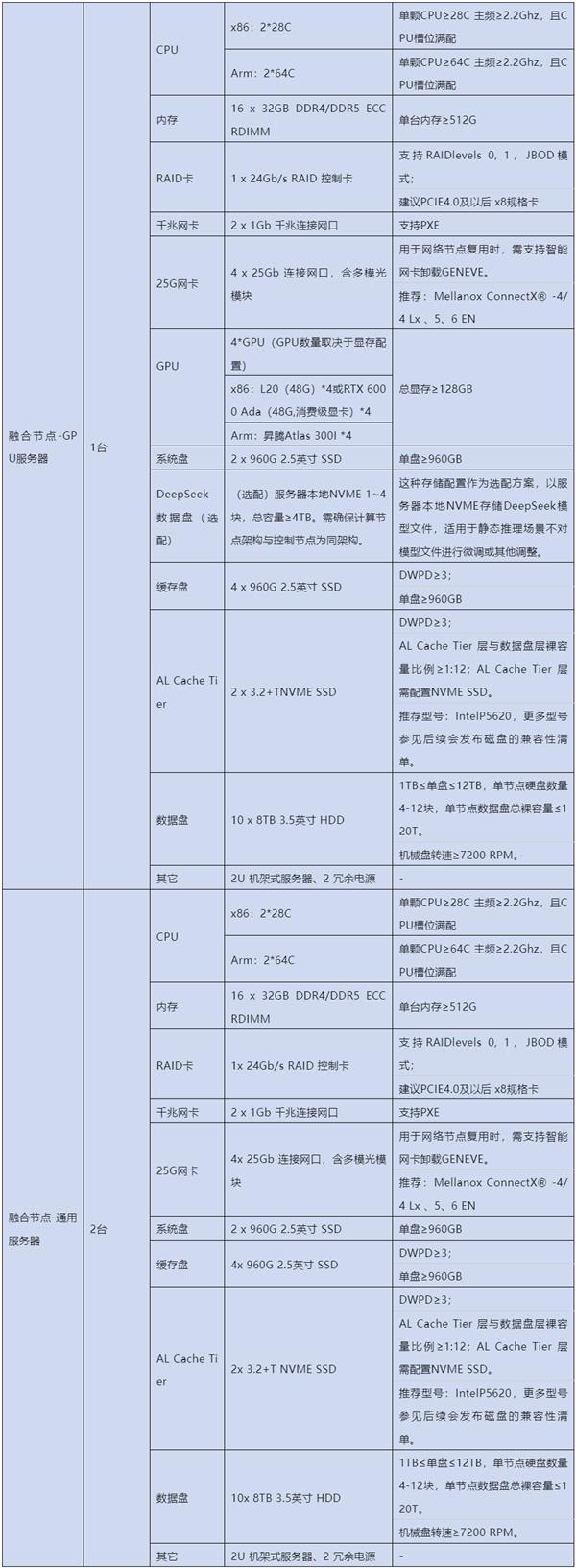

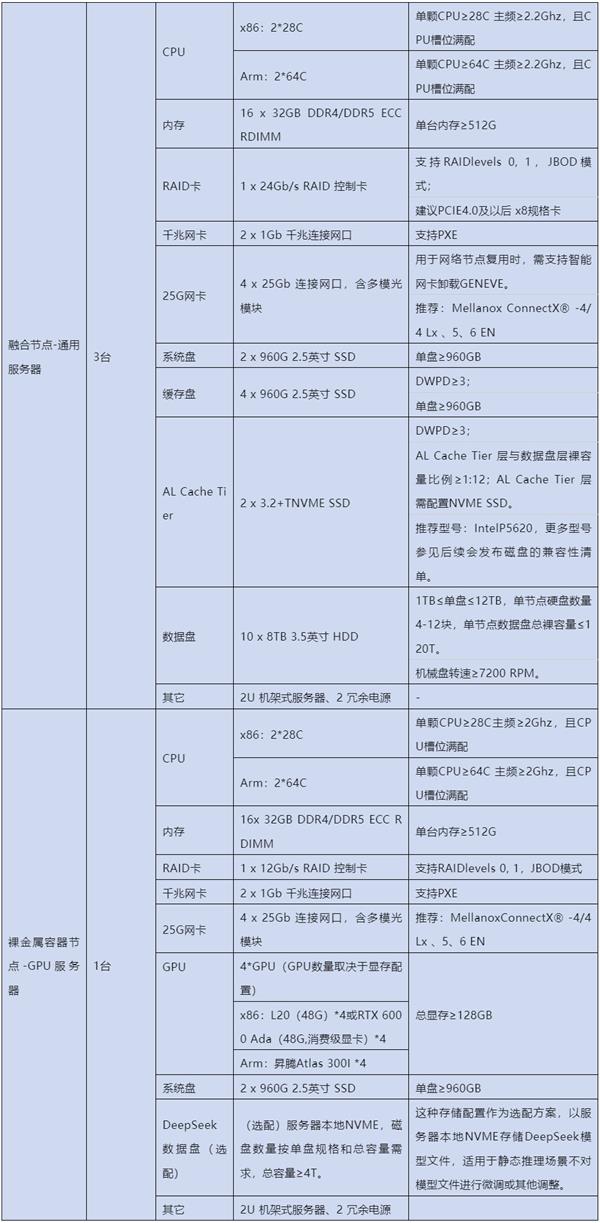

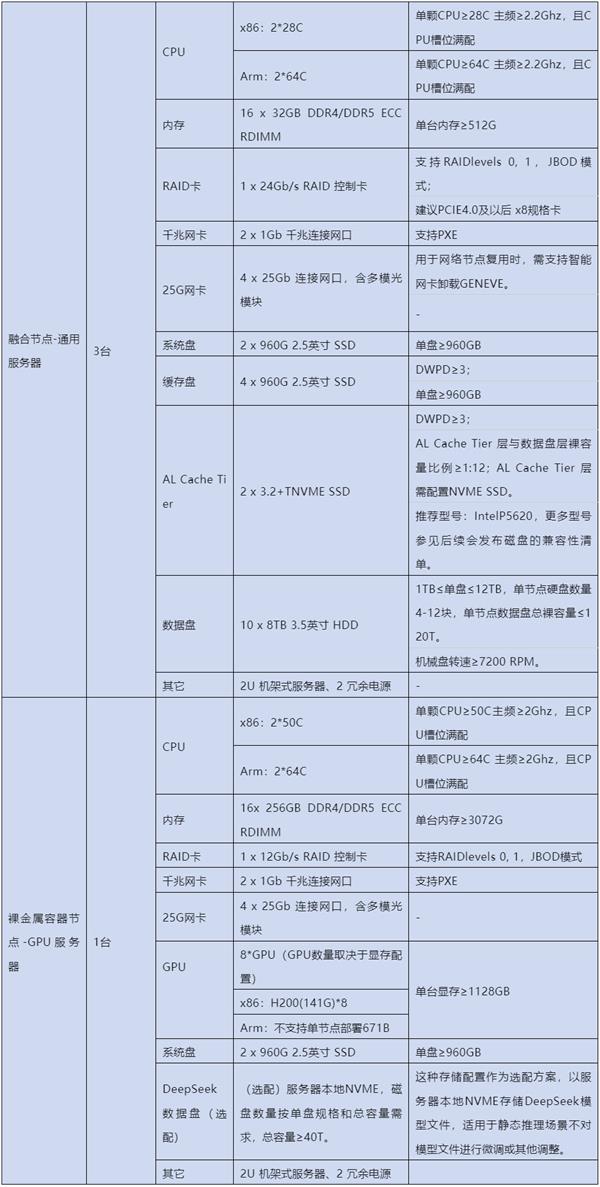

2. 新建 EasyStack AI 基础设施推荐配置——DeepSeek 7B/32B/70B/671B(面向推理)

对于新建基础设施场景,EasyStack 提供灵活方案供用户选择。小参数规模的 DeepSeek 私有部署,如 7B/32B,DeepSeek 算力节点可以选择采用云主机部署或者裸金属容器部署两种方式;对于 70B/671B 参数规模的 DeepSeek,推荐使用裸金属容器方式承载 DeepSeek。无论采用哪种方案新建 EasyStack AI 基础设施,同一资源池既可运行 DeepSeek 智能引擎,也可并行支撑传统业务应用,最优化投入产出比。

7B 参数规模新建 AI 基础设施场景,通过云主机承载 DeepSeek 的推荐配置如下:

7B 参数规模新建 AI 基础设施场景,通过裸金属容器承载 DeepSeek 的推荐配置如下

32B 参数规模新建 AI 基础设施场景,通过云主机承载 DeepSeek 的推荐配置如下:

32B 参数规模新建 AI 基础设施场景,通过裸金属容器承载 DeepSeek 的推荐配置如下:

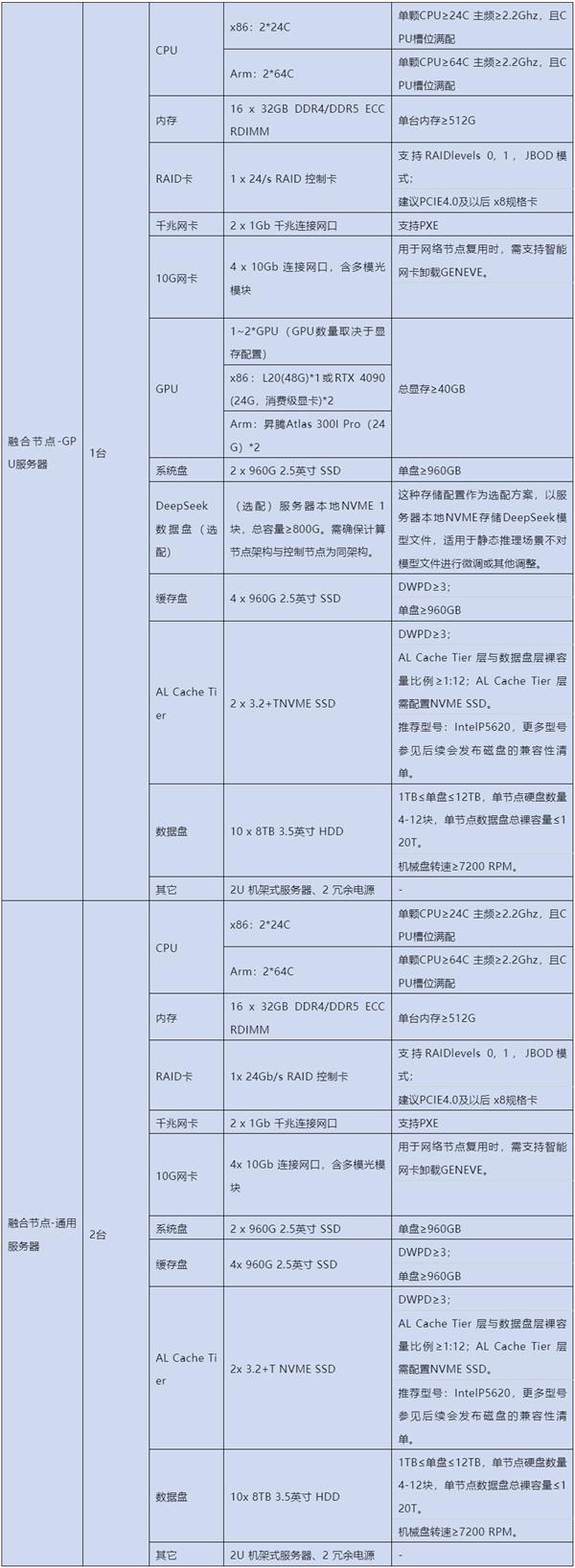

对于 70B/671B 参数规模的 DeepSeek,推荐使用裸金属容器方式承载 DeepSeek。此时 DeepSeek 算力节点推荐配置等同于上文中扩容场景中的推荐配置,在新建场景下,需要为 DeepSeek 算力节点提供 3 台融合节点-通用服务器的基础设施底座,此时新建的 EasyStack AI 基础设施部署形态为 3 台基础设施底座+DeepSeek 算力节点,在初始部署阶段即开箱实现 CPU/GPU 异构算力、分布式存储、高速网络的全栈融合,可以同时支持 DeepSeek 智能引擎和传统应用。

例如 671B 参数规模,如采用单台 DeepSeek 算力节点,则新建场景下的推荐配置如下,671B 2 台、4 台 DeepSeek 算力节点以及 70B 单台、2 台 DeepSeek 算力节点的新建场景配置以此类推。

来源:互联网