继去年发布并开源 VisualGLM-6B 和 CogVLM 之后,智谱 AI 宣布近期将推出新一代多模态大模型 CogVLM2

继去年发布并开源 VisualGLM-6B 和 CogVLM 之后,智谱 AI 宣布近期将推出新一代多模态大模型 CogVLM2。这款模型以其 19B 的参数量,在性能上接近或超越了 GPT-4V。

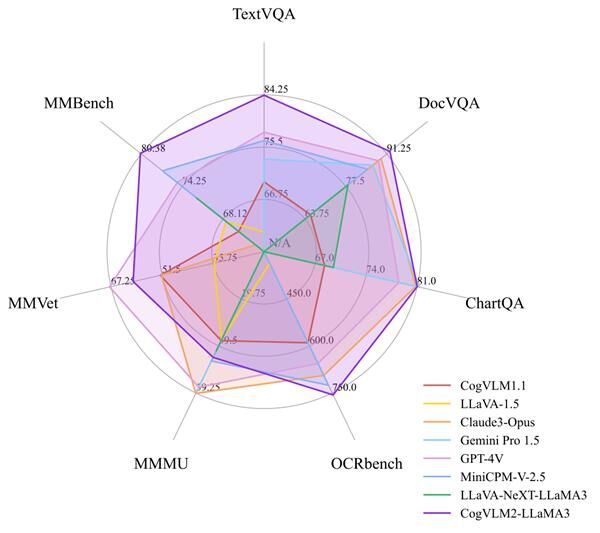

据悉,CogVLM2 系列模型在多个关键指标上实现了显著提升,如在 OCRbench 基准上性能提升 32%,在 TextVQA 基准上性能提升 21.9%,且模型具备了较强的文档图像理解能力(DocVQA)等。此外,CogVLM2 支持 8K 文本长度和高达 1344*1344 的图像分辨率,同时提供中英文双语的开源模型版本。

CogVLM2 继承并优化了上一代模型的经典架构,采用了一个拥有 50 亿参数的强大视觉编码器,并创新性地在大语言模型中整合了一个 70 亿参数的视觉专家模块。这一模块通过独特的参数设置,精细地建模了视觉与语言序列的交互,确保了在增强视觉理解能力的同时,不会削弱模型在语言处理上的原有优势。这种深度融合的策略,使得视觉模态与语言模态能够更加紧密地结合。

值得注意的是,尽管 CogVLM2 的总参数量为 190 亿,但实际激活的参数量仅约 120 亿,这得益于精心设计的多专家模块结构,显著提高了推理效率。此外,CogVLM2 能够支持高达 1344 分辨率的图像输入,并引入了专门的降采样模块,以提高处理高分辨率图像的效率。

在多模态基准测试中,CogVLM2 的两个模型,尽管具有较小的模型尺寸,但在多个基准中取得 SOTA 性能;而在其他性能上,也能达到与闭源模型(例如 GPT-4V、Gemini Pro 等)接近的水平。

开发者可以通过 GitHub、Huggingface、魔搭社区和始智社区下载 CogVLM2 的模型,团队还透露,GLM 新版本会内嵌 CogVLM2 能力,在智谱清言 App 和智谱 AI 大模型 MaaS 开放平台上线。

来源:互联网