AI 中心的权力地图。

来源:Time

链接:https://time.com/collection/time100-ai

编译:芯芯

编辑:靖宇

这是 AI 的时代。

2022 年,没人能预料到,以大模型为代表的人工智能技术,成为这个时代独撑科技行业上行的力量。

在这一波「AI 复兴」的浪潮中,谁是距离权力最近的人?谁又能掌握塑造这股新兴科技力量的方法?

近日,美国时代周刊选出了 AI 行业最重要的 100 人。

这份百人名单分成了 4 大类,包括引领者 Leaders、创新者 Innovators、塑造者 Shapers 和思想者 Thinkers,每一类分别有 25 人入选。

其中,OpenAI CEO Sam Altman、谷歌 DeepMind CEO 德米斯·哈萨比斯、百度创始人、董事长兼首席执行官李彦宏等企业家以及伊隆·马斯克被归为领导者行列;而在创新者名单中,华裔科幻作家特德·姜 Ted Chiang、《黑镜》编剧 Charlie Brooker 等作者和艺术家,与 Character.AI 创始人一同被列入创新者范畴。

由全球各国 AI 机构、以及参与制定 AI 政策的官员,成为真正意义上 AI 的「塑造者」;由 李飞飞、Geoffrey Hinton、Yann LeCun 领衔的 AI 学者团队,组成了 AI 行业的「思想者」方阵,有趣的是,他们之中,既有坚信通用人工智能为时尚早,也有人不太坚定的认为,AI 可能最终拥有毁灭人类的能力。

这 100 个人,或许呈现了 AI 发展的权力地图。

下面是 Time100 AI 的名单:

引领者 Leaders

人物:达里奥·阿莫代、丹妮拉·阿莫代兄妹(Dario and Daniela Amodei)

职务:Anthropic 首席执行官和总裁

简介:Anthropic 开发了一种名为「合宪 AI」的全新方法,来明确规定 AI 系统应遵守的价值观,并将这些方法嵌入到了聊天机器人 Claude 中,被认为是 GPT-4 的一个强有力竞争对手。他们的研究还致力于使 AI 系统更易解释,使开发人员能够深入了解其内部运作。该公司强调 AI 安全的重要性,将自己定位为人工智能安全研究实验室,并筹集了大量资金,认为商业化是进行有意义的 AI 安全研究的必要手段,在此过程中也将努力平衡商业和社会目标。

人物:萨姆·阿特曼(Sam Altman)

职务:OpenAI 首席执行官

简介:OpenAI 发布了 ChatGPT 和 GPT-4,在全球掀起了 AI 热潮,同时也推动了有关 AI 监管的讨论。萨姆·阿特曼认为,人类智慧和适应能力足以应对强大的人工智能,前提是这些人工智能的发布是安全和逐步的,让政策制定者和公众了解人工智能的发展和潜在风险是重要的责任,而决定如何应用这项技术应由社会共同决定。

人物:德米斯·哈萨比斯(Demis Hassabis)

职务:Google DeepMind 首席执行官和联合创始人

简介:作为 DeepMind 的首席执行官,他领导了计算机科学家团队,在解决复杂的蛋白质折叠问题和创造击败人类的围棋 AI 方面取得了成功。在 2023 年 4 月,Google 重新组织了公司的 AI 团队,他获得了更多权力。现在,Google DeepMind 正在开发一个名为 Gemini 的大型 AI 模型,德米斯·哈萨比斯暗示它可能能够超越 OpenAI 的 GPT-4。Gemini 将支持多模式,这意味着它不仅可以处理文本,还可以处理其他媒体形式,如图像,他将这视为实现 AGI 更大追求的一部分。

人物:克莱门·德兰格(Clément Delangue)

职务:Hugging Face 首席执行官

简介:Hugging Face 是一个开源的机器学习平台,全球研究人员汇聚在这里,分享他们的 AI 模型、数据集和实践。开源社区在 AI 领域内的创新或有能力超越业内科技巨头,但开源 AI 的崛起可能是一把双刃剑,不仅会将强大的 AI 模型交到善意人士手中,也可能交到那些可能滥用它的人手中。克莱门·德兰格称,Hugging Face 倡导更多的透明度、更多的开放性,以及在 AI 能力方面权力的更多分配。

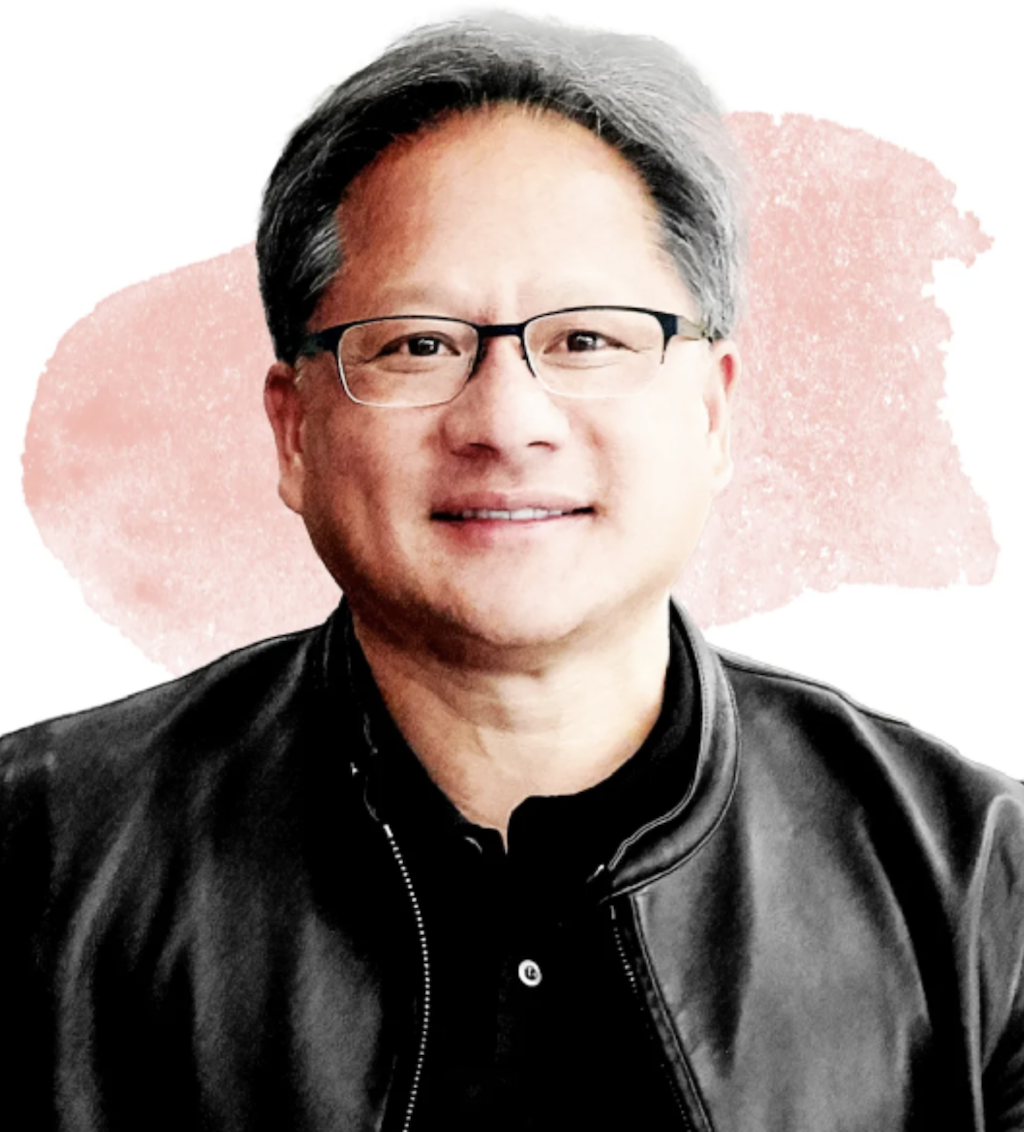

人物:黄仁勋

职务:英伟达首席执行官和联合创始人

简介:黄仁勋年轻时曾在 AMD 担任微处理器设计师,于 1993 年创办了英伟达,最初的业务是为沉浸式的视频游戏做硬件。如今,总部位于加利福尼亚州圣克拉拉的英伟达成为全球占主导地位的芯片制造商,驱动了人工智能革命,随着大型语言模型的爆炸性增长,对英伟达芯片的需求飙升,同时也带动英伟达的股票飙涨,公司市值在 2023 年 8 月底达到 1.1 万亿美元。

其余入选的「引领者」还有:

Lila Ibrahim(Google DeepMind COO)

伊隆·马斯克(xAI 创始人)

Raquel Urtasun(Waabi 创始人和 CEO)

Alex Karp(Palantir Technologies 联合创始人和 CEO)

Reid Hoffman(创业者和投资人)

Greg Brockman(OpenAI 联合创始人和主席)

李彦宏(百度创始人、董事长和 CEO)

Marc Andreessen(创业者和投资人)

Sandra Rivera(英特尔数据中心和 AI 业务总经理)

Aidan Gomez(Cohere 联合创始人和 CEO)

Daniel Gross(创业者和投资人)

李开复(创新工场主席和 CEO)

Jaime Teevan(微软首席科学家)

吴恩达 Andrew Ng(DeepLearning.AI 创始人)

Kevin Scott(微软 CTO 和 AI 执行副总裁)

Clara Shih(Salesforce AI CEO)

Alexandr Wang(Scale AI 联合创始人和 CEO)

Mustafa Suleyman(Inflection AI 联合创始人和 CEO)

Marc Raibert(Boston Dynamics AI Institute 执行主管)

创新者 Innovators

人物:特德·姜(Ted Chiang)

职务:科幻作家

简介:特德·姜或许是世界上最受欢迎的活着的科幻作家之一。他的科幻作品提出的问题包括,如果学习外星语言改变了你对时间的感知,会怎么样?如果人类创造了人工生命,我们对它负有什么责任?等等。

最近,现年 56 岁的特德·姜开始成为 AI 及其背后公司的最锋利的批评家之一,他将 ChatGPT 比作「网上所有文本的模糊 JPEG 图像」,还认为如果没有结构性的经济变革,AI 的崛起将加剧财富不平等,削弱工人力量,并巩固科技寡头统治地位,如果进步不能为工作的人提供更好的生活,即使效率提高了,也没有意义。

人物:查理·布鲁克(Charlie Brooker)

职务:编剧

简介:《黑镜》或许是关于 21 世纪科技的最具代表性的流行文化作品,而查理·布鲁克是其背后的重要编剧。AI 是他想象力中最重要的主题之一,他的作品栩栩如生地呈现了机器人杀手蜜蜂、被奴役成为意识复制品的 AI 家庭助手,在极端情景中可以给人们的情感、社交和人身安全带来什么后果。他在这个领域的故事因其关于机器学习过程的想象力和准确性,受到了 AI 专家的赞扬。有一些令人恐惧的思维实验,甚至已经成为现实中的真正业务。此外,人们担心好莱坞将使用 AI 来取代人类编剧,布鲁克也加入了抗议行列。

人物:佩洛诺米·莫伊洛阿(Pelonomi Moiloa)

职务:Lelapa AI 联合创始人、CEO

简介:非洲也有自己的 AI。Lelapa AI 这家初创公司的名字在南非的索托语和茨瓦纳语中意为「家」,公司的主旨是通过 AI 改善非洲人的生活。该公司的第一个重大项目是利用 AI 协助处理通常被其他研究者忽视的非洲语言,如祖鲁语、索托语和南非荷兰语,这些语言共有大约 2500 万人使用。莫伊洛阿最热衷的项目是训练人工智能模型正确发音南非的名字。她认为,非洲名字经常被严重错误发音,甚至达到无法识别的程度,而她在此看到了机遇。

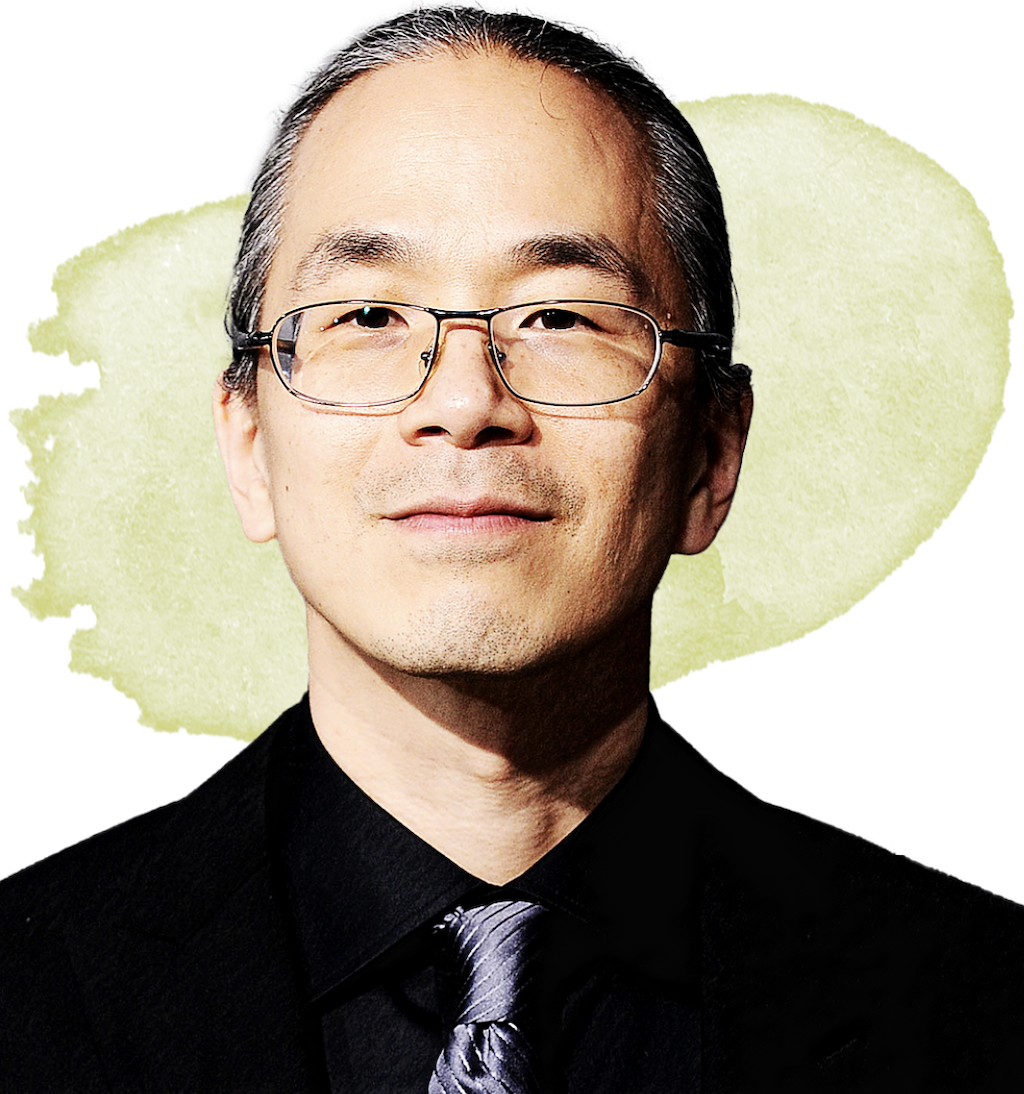

人物:诺姆·沙齐尔(Noam Shazeer)

职务:Character.AI 联合创始人、CEO

简介:2017 年,沙齐尔在谷歌时共同撰写了一篇名为「Attention Is All You Need」的研究论文,提出了 Transformer 架构,为后来的 AI 发展奠定了重要基础,沙齐尔离开谷歌创办了 Character.AI。Character.AI 是一个网站,允许你与著名人物、真实和虚构的人物进行对话,不管是伊丽莎白二世还是伊隆·马斯克。Reddit 和其他网络社区充满了赞扬该平台的人,称它帮助他们解决问题,让他们感到不再孤单,与抑郁症或孤独作斗争。但 Character.AI 也有其批评者,他们担心这项新技术带来负面影响,比如让青少年一代不再与身边真实的人交谈,让年轻人「更难区分现实和虚构」。

人物:克里斯托瓦尔·瓦伦苏埃拉(Cristóbal Valenzuela)

职务:Runway 联合创始人、CEO

简介:对好莱坞的演员来说,他们一部分因担心 AI 将越来越多地用于生成电影场景而举行罢工,Runway 可能是他们头号公敌,这是最知名的 AI 视频生成公司之一,其技术已经被用于制作获得奥斯卡奖的电影《无所不在的无限空间》以及 Stephen Colbert 的《深夜秀》。自 2018 年在布鲁克林创立以来,Runway 已经筹集了超过 2 亿美元的资金,瓦伦苏埃拉承认,如果技术像他想象的那样发展,创意产业中的许多工作将不复存在,但更多的人将能够成为电影制作人。

人物:Rootport

职务:日本漫画作者

简介:Rootport 是一位匿名的日本漫画创作者,他不懂如何绘画。当 AI 文本到图像生成器在 2022 年大热时,当时 36 岁的 Rootport 使用 Midjourney 的 AI 艺术生成器来创作插图,并通过类似的 AI 软件来修补手部和食物等细节。他制作了第一部完全由 AI 绘制的日本漫画,共渲染了近 9000 帧,并将它们拼合在面板中,这部全彩漫画名为《赛博朋克:桃太郎》,共 108 页,他表示这本漫画如果由一名日本漫画家制作,需要一年多的时间,而 Rootport 在六周内完成了这个项目。Rootport 表示他将继续使用 AI 来绘制漫画,称「对于大多数漫画艺术家来说,「他们想要表达的故事」应该是他们的首要任务,技术只是表达那个故事的手段。」

其余入选的「创新者」还有:

Holly Herndon(音乐人)

Grimes(音乐人)

Neal Khosla(Curai 联合创始人和 CEO)

Stephanie Dinkins(艺术家)

Sougwen Chung(艺术家)

Lilly Wachowski(电影制作人)

Manu Chopra(Karya CEO)

Kate Kallot(Amini 创始人和 CEO)

Ziad Obermeyer(加州伯克利大学助理教授)

Alison Darcy(Woebot Health 创始人和主席)

Nathaniel Manning(Kettle 联合创始人和 COO)

Tushita Gupta(Refiberd 联合创始人和 CTO)

Andrew Hopkins(Exscientia 创始人和 CEO)

Linda Dounia Rebeiz(艺术家)

Richard Socher(You.com 创始人和 CEO)

Keith Dreyer(Mass General Brigham 首席数据科技家)

Nancy Xu(Moonhub 创始人和 CEO)

塑造者 Shapers

人物:阿隆德拉·尼尔森(Alondra Nelson)

职务:美国白宫政策顾问

简介:作为白宫科学和技术政策办公室的主任,尼尔森去年 10 月负责监督了人工智能权利法案蓝图的发布,该文件为 AI 建设者和决策者提供了一个框架,旨在确保人工智能是公益的力量。她于今年 2 月离开白宫,但仍然担任着几个有影响力的职位,包括作为美国进步中心的研究员,为州立法者和国会议员提供人工智能政策建议。她在行业、政策制定者和民间之间进行联络活动。

尼尔森认为,美国、欧盟、英国、南非等地即将举行的 2024 年选举使 AI 监管变得更加紧迫,因为 AI 已经被用于针对政治家生成深度伪造视频,并可能被游说团体武器化,以更大规模地传播谣言,为此需要更多监管。

人物:伊恩·霍加思(Ian Hogarth)

职务:英国前沿人工智能特别工作组主席

简介:作为一位前科技创业家和投资者,伊恩·霍加思已经通过押注机器学习公司赚取了一大笔财富。今年四月,霍加思发表了一篇被广泛传播的文章,警告超级智能人工智能的长期风险,称最坏的情况下可能「导致人类灭绝或毁灭」。两个月后,英国政府宣布任命这位现年 41 岁的英国人为人工智能安全倡议的负责人,该倡议现在变为前沿人工智能特别工作组,英国为此投入了 1 亿英镑。

值得注意的是,霍加思是无偿工作的,据称他将其视为「至关重要的公共服务」。工作组近期的安全性研究重点包括,用 AI 工具进行网络攻击的风险,以及用 AI 设计和合成危险病原体的风险。

人物:玛格丽特·维斯塔格(Margrethe Vestager)

职务:欧洲委员会执行副主席

简介:作为欧洲的数字领袖,她赢得了相当高的声誉。这个 55 岁的丹麦人表现出了一种意愿,愿意对一些全球最大的科技巨头进行反垄断规则的调查,甚至对其进行罚款。她在过去两年里一直领导着欧盟人工智能法案的制定,她认为,人工智能法规本质上是一个全球性事务,并呼吁建立一个「国际行为准则」来跟上其快速发展的步伐。

人物:安娜·埃休(Anna Eshoo)

职务:美国国会代表

简介:自今年 1 月以来,安娜·埃休担任了国会人工智能小组(Congressional AI Caucus)的联合主席,这是一个致力于向政策制定者教育人工智能技术、经济和社会影响的跨党派组织。她工作的主要重点是召集主题专家,帮助政策制定者制定美国应该如何监管人工智能的路线图。

今年 6 月,她与其他代表一起提出跨党派立法,谋求创建一个国家委员会,专门负责监管人工智能。她今年还提出了一项法案,要求战略准备和应对管理局研究人工智能对美国生物安全的潜在威胁,包括它如何被恶意行为者用于开发类似 SARS-CoV 或埃博拉病毒的新病原体。

人物:泰德·卢(Ted Lieu)

职务:美国国会代表

简介:现年 54 岁的卢是国会议员中仅有的三位计算机科学学位持有者之一。今年一月,他使用 ChatGPT,以自己的风格和声音提示其编写一份全面的国会决议,结果出来了一份不需要编辑的决议。当被问及他是否担心美国加强监管会限制该国与外国公司竞争的能力时,卢表示政策制定者需要小心,对于那些可能损害创新的法规,如果其他国家没有这样做,他认为美国就不应该制定这些法规,除非他们真的必须这样做。总的来说,他认为监管需要鼓励创新,同时防止由生成式人工智能可能引发的危害。

人物:特里斯坦·哈里斯(Tristan Harris)

职务:「人道科技中心」联合创始人兼执行主管

简介:今年三月,哈里斯发布了一封公开信,呼吁所有人工智能实验室暂停工作六个月,并利用这段时间重新评估该行业的方向,得到了科技领域众多领袖的签署支持,包括伊隆·马斯克、苹果联合创始人史蒂夫·沃兹尼亚克等。然而事实上,没有一个实验室真正采纳了这一建议,停止工作,尽管哈里斯并不感到意外。然而,他的希望是,至少这让他们思考了一下。

他认为,现在人工智能的开发浪潮就如同核武器竞赛,「设计师们担心如果他们不建造,更糟糕的行为者会建造。」最好是「让好人建造它」。

其余入选的「塑造者」还有:

Meredith Whittaker(Signal 总裁)

James Manyika(谷歌研究、技术与社会高级副总裁)

Jack Clark(Anthropic 联合创始人兼政策主管)

Anna Makanju(OpenAI 全球事务副总裁)

Omar Al Olama(阿联酋人工智能部长)

Kelly McKernan(艺术家)

Eric Schmidt(Schmidt Futures 联合创始人)

Richard Mathenge(非洲内容审核工会组织者)

Sneha Revanur(Encode Justice 创始人兼总裁)

Tristan Harris(人道科技中心联合创始人兼执行主管)

Joy Buolamwini(算法正义联盟创始人兼首席艺术家)

Eliezer Yudkowsky(机器智能研究所联合创始人)

Verity Harding(剑桥大学 AI 与地缘政治项目主任)

Sarah Chander(欧洲数字权利高级政策顾问)

Nina Jankowicz(信息弹性中心副总裁)

Romesh and Sunil Wadhwani(Wadhwani AI 联合创始人)

Elham Tabassi(NIST 新兴技术副主任)

Dan Hendrycks(AI 安全中心执行主任)

Jess Whittlestone(长期弹性中心 AI 政策主管)

John Honovich(IPVM 创始人)

思想者 Thinkers

人物:杰弗里·辛顿(Geoffrey Hinton)

职务:图灵奖获得者、多伦多大学荣誉教授

简介:作为过去 50 年来最有影响力的人工智能研究者之一,杰弗里·辛顿今年经历了「缓慢的顿悟时刻」。他一直致力于构建模拟人脑的人工智能系统,大部分时间都在学术界度过,直到 2013 年加入谷歌。

他一直认为人脑比他和其他人正在构建的机器更优越,如今他意识到「我们现在拥有的数字智能可能已经比大脑更优越。只是尺寸还没有扩展得那么大。」鉴于人工智能公司目前扩大模型规模的速度,可能不到五年,人工智能系统的连接数将达到 100 万亿个,大致相当于人脑神经元之间的连接数。

因此,他感到担忧,于是在五月份辞去了谷歌副总裁和工程专家的职务,并接受了一系列采访,自由发声,谈论 AI 的危险以及他对帮助创造这项技术的懊悔。

人物:李飞飞

职务:斯坦福大学教授

简介:李飞飞出生于中国成都,15 岁时移居美国,她的研究为今天运行的图像识别人工智能系统奠定了基础,并扩大了 AI 在医疗保健领域的应用。除了 2017 年到 2018 年在谷歌工作之外,李飞飞的职业生涯大部分时间都在学术界度过,推动了人工智能图像识别系统的发展。

最近,李飞飞担心学术界和工业界之间的全球资源差距,呼吁政府提供人工智能计算资源,主张政府进行更多投资,以确保 AI 为公共利益服务。据时代杂志称,李飞飞今年观看了电影《奥本海默》,并电影与现实的相似之处所打动,称「非常深刻地感受到科学家的责任感。我们都是世界的公民。」

人物:阿贝巴·比尔哈内(Abeba Birhane)

职务:认知科学家

简介:在最近一篇论文中,比尔哈内和她的合著者得出了一个结论:在更大规模的数据集上训练的 AI 模型更有可能显示有害的偏见和刻板印象。人工智能模型的训练数据集越来越大,这些数据集是从互联网上收集而来的,包括来自互联网的最黑暗的角落。

比尔哈内意识到,随着这些数据集从数百万个个体数据膨胀到数十亿个个体数据,几乎没有人在系统性地检查它们是否含有有害内容,这可能导致人工智能变得具有结构性的种族主义、性别歧视和其他偏见。她提出,应该对「规模越大越好」的说法保持高度怀疑,现在 AI 公司们建立内容审核过滤、使用强化学习激励模型的无害行为等模式不可持续。

人物:谢恩·莱格(Shane Legg)

职务:Google DeepMind 联合创始人兼首席 AGI 科学家

简介:莱格自 DeepMind 成立以来一直担任首席科学家,在 2023 年 4 月 DeepMind 与 Google Brain 合并形成 Google DeepMind 后,他成为了首席 AGI 科学家。据称在 20 多年前,他早就做过一个预测,即人类级别的机器智能在 2028 年之前会被创造出来的概率为 50%。

他一直领导着 DeepMind 的 AGI 技术安全团队,该团队试图确保一旦开发出强大的人工智能系统,它们将按照其创造者的意图行事,并防止类似的灾难再次发生,即 AI 系统自行产生有害目标。莱格估计,到 2028 年,他和其他人将有 70% 的机会解决这个问题。他认为,世界上有很多问题可以通过拥有一个极其有能力和有道德的智能系统来得到解决,世界可能会变得更好得多。

人物:曾毅

职务:中国科学院大学教授

简介:曾毅的研究主要围绕类脑人工智能、人工智能哲学与伦理展开。他还是牛津大学人工智能伦理研究所顾问委员会委员,联合国教科文组织人工智能伦理特别专家组成员,以及国家新一代人工智能治理委员会委员。大约在 2016 年,曾毅对人工智能系统带来的风险越来越担忧,他开始花更多的时间与政策制定者合作,期望制定有益的人工智能发展规则。

据其称,他高度参与政策制定,参与撰写了《人工智能北京共识》,帮助制定了联合国教科文组织关于人工智能伦理的建议,同时倡导加强国际合作。他对时代杂志表示,「我觉得我有责任让世界知道,中国的科学家和政策制定者真的有着类似的想法」,他认为中美两国在对待人工智能风险的态度方面有很多共同之处,在人工智能安全治理方面,全球「实际上别无选择」「必须合作」。

人物:伊利亚·苏茨克弗(Ilya Sutskever)

职务:OpenAI 联合创始人兼首席科学家

简介:在 2015 年加入 OpenAI 成为创始成员之前,苏茨克弗因在计算机视觉和机器翻译领域的突破而闻名遐迩。今年 7 月,OpenAI 宣布他将成为其新成立的超级对齐(Superalignment)团队的联合领导,该团队旨在解决如何确保超级智能 AI 符合人类利益的技术挑战。根据苏茨克弗的看法,智力较低的存在可以确保智力更强大的存在符合他们的利益。这个先例就是人类婴儿。

在他看来,了解如何将某些价值观灌输到明显超越人类的系统中极其重要。AI 系统最终将变得非常强大,「我们将无法理解它们。它们将比我们聪明得多。到那个时候,非常关键的是,印记非常深刻,以便 AI 对我们的感觉与人类对待婴儿的感觉一样。」

其余入选的「思想者」还有:

Rumman Chowdhury(Humane Intelligence 首席执行官兼联合创始人)

Timnit Gebru(分布式人工智能研究所创始人兼执行董事)

Kate Crawford(南加州安纳伯格学院教授、Knowing Machines 创始人)

Pushmeet Kohli(Google DeepMind 研究副总裁)

Yejin Choi(华盛顿大学教授)

Yann LeCun(Meta 首席人工智能科学家)

Inioluwa Deborah Raji(Mozilla 基金会研究员)

Max Tegmark(未来生命研究所联合创始人兼总裁)

Yoshua Bengio(蒙特利尔机器学习算法研究所科学主任)

Emily M. Bender(华盛顿大学教授)

Margaret Mitchell(Hugging Face 首席人工智能伦理科学家)

Paul Scharre(新美国安全中心执行副总裁)

Jan Leike(OpenAI 超级对齐领导之一)

Paul Christiano(Alignment Research Center 创始人)

Kalika Bali(微软研究印度首席研究员)

Stuart Russell(加州大学伯克利分校教授)

Arvind Narayanan & Sayash Kapoor(普林斯顿大学教授和博士候选人)

Shakir Mohamed(Google DeepMind 研究总监、Deep Learning Indaba 创始人)

图片来源:Time