降低 80% 的图像对抗风险 蚂蚁集团升级基于可信 AI 技术的内容安全解决方案

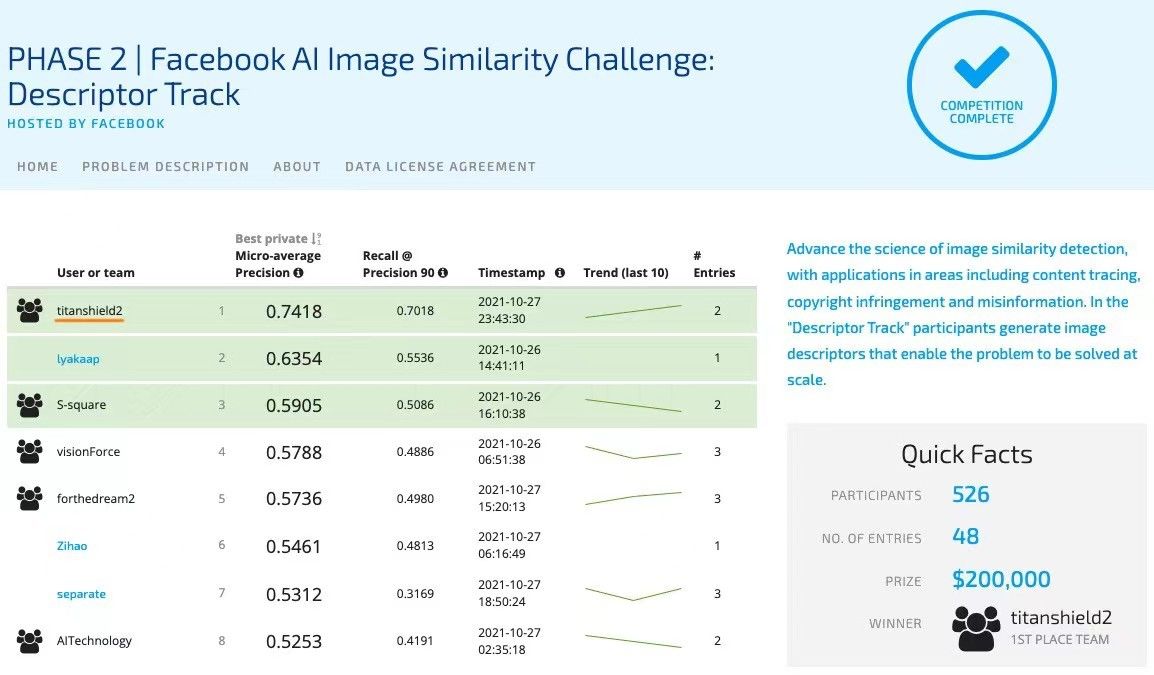

12 月 10 日,由国际人工智能顶会 NeurIPS 与 Facebook AI 联合举办的图像相似匹配竞赛 ISC2021 落下帷幕。本次比赛共有 1635 支参赛队伍参加,是今年 NeurIPS 会议上最具影响力的比赛之一。来自蚂蚁集团的 TitanShield Team(titanshield2)以超越第二名 10 个百分点的成绩斩获图像表征赛道冠军。据悉,此次夺冠团队采用的技术方案是由蚂蚁集团独立自研的、「基于特征兼容自监督学习框架」的预训练模型,能够针对性地解决内容安全风控领域常见的敏感信息更迭速度快、风控模型训练不及时等问题。作为可信 AI 技术研究及应用中的一环,该技术上线后可降低 80% 的图像对抗风险,将有助于极大地提升在内容安全等相关应用领域中的 AI 鲁棒性(Robustness)。

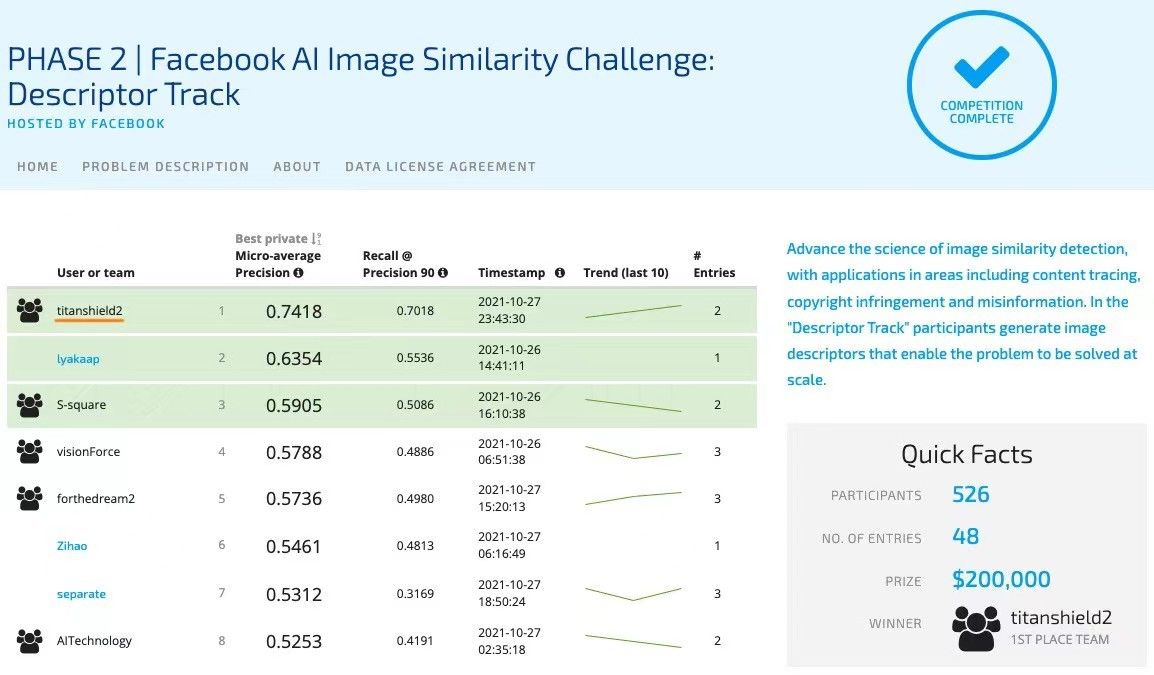

ISC2021 图像表征赛道成绩排行榜

ISC2021 图像表征赛道成绩排行榜鲁棒性:人工智能的第一场大考

作为人工智能下一阶段快速发展的瓶颈所在,安全和可信性决定了人工智能未来三十年的发展速度和应用深度;而 AI 的鲁棒性,即抗打击能力及稳定性,则成为了人工智能的第一场大考。以图片识别领域为例,无人驾驶车辆上加载的图像识别模型可能因为图像识别错误,而酿成车祸;版权保护场景下,盗版商通过图片的变形,试图绕开反盗版模型的审查;内容安全场景中,将涉毒涉黄信息隐匿在看似合法的图片中,更是黑产团伙获利的惯用伎俩。「如果抵挡不住攻击,识别结果不可信,那么 AI 模型不仅失去了它存在的意义,还会成为另一个风险敞口」,蚂蚁集团资深技术专家博山在采访中强调。

可信 AI:做内容安全战场的定海神针

一直以来,敏感信息复杂多变,模型训练样本不足,是各家企业内容安全风控的核心痛点。例如,新增的劣迹艺人、潮流商品的版权图片,AI 不仅无法预判其出现的趋势,还需要在其出现后快速做出风控响应;而在儿童软色情等问题场景下,由于模型训练样本不足,如何让 AI 实现有效风控成为难题。不仅如此,在全行业分工协作程度不断加深的今天,各类企业、商户组成了庞大的生态服务链。任一薄弱环节,都可能成为黑产的突破口,对企业自身及关联企业带来巨大的负面影响。但由于训练样本的敏感性等,如何实现联合风控,成为行业共同面临的困境。

而此次比赛中,夺冠团队所采用的「基于特征兼容自监督学习框架」的预训练模型,在图像识别领域,极大地缓解和应对了上述问题。首先,该技术能够基于公开数据集进行预训练,帮助 AI 提前完成同类风险预演。其次,在传统的 AI 识别中,模型识别依赖人工投喂标注了「特征」的样本;例如,模型在识别熊猫图片前,需要先「学习」熊猫的特征——「眼部有黑色毛发」、「常与竹子一同出现」等等。而借助「自监督学习」技术,该模型可以通过自主学习抓取「特征」,降低 70% 标注量,训练时间也从原本的一周缩短至 3 天。同时,创新的「特征兼容」方案,能够实现在两个业务场景或两家企业间,借助「特征」信息的兼容共享,实现风险联防。

据悉,该模型及相关技术作为蚂蚁集团内容安全风控决策引擎的重要组成部分,目前已在支付宝内容安全场景中全面上线,可整体降低 80% 的图像对抗风险。