手握怎样的数据,就能做出怎样的 AI,如果数据片面,那么研究的成果毫无疑问也是片面的。

「AI 已经能看出你藏起来的小秘密了!」

斯坦福大学的两位研究员发布了一个研究报告,他们用数十万张约会网站的照片来训练一个面部识别系统,尝试让 AI 学会通过照片来判断一个人是否是同性恋。

(研究介绍页)

权威外媒《经济学人》第一个报道了这个研究,之后其他媒体也做了跟进的报道,诸如《可怕!AI 只要一张照片就能看出来你是不是同性恋》的标题很快散播在各家媒体网站上。

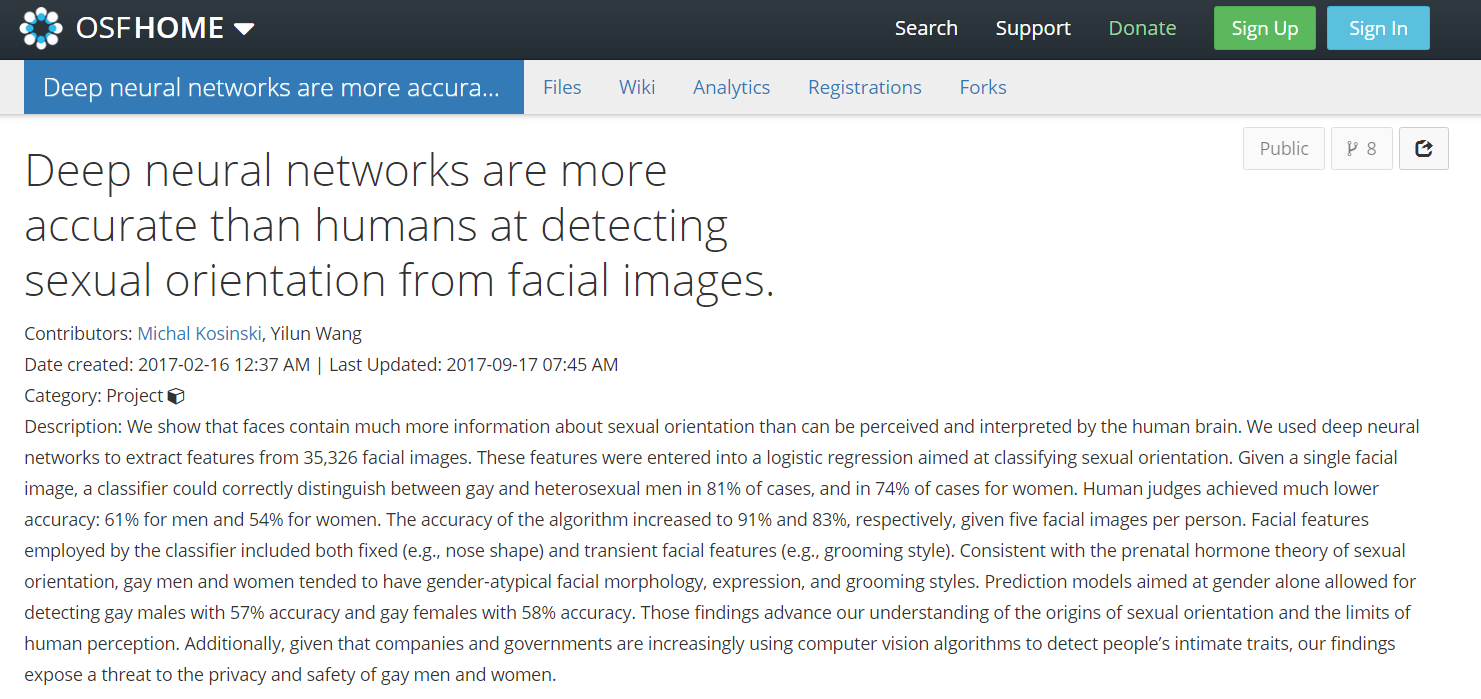

从多家外媒的报道来看,研究指出通过一张面部图片,该系统就可以判断出图片上的人性向如何,判断准确率男性 81%,女性 71%,如果同一人物的图片素材达到 5 张,则准确率可以上升到男性 91%,女性 83%。

但著名科技媒体 The Verge 指出,其实这类报道出现了偏差,斯坦福大学研究员们的这个研究并不是像诸多文章中写的那样,只要一张照片就能看出来性取向,事实上,该研究是通过两张图片二选一的机制让机器选出「更可能是同性恋」的图片。这种对比判断其实是从 50% 的随机几率开始计算的,因此与单纯对一张图的分析有着很大的区别。

除了报道的理解偏差以外,这项研究本身也遭到了不少批评声。马里兰大学的社会学家 Philip Cohen 就表示,人们本来拥有一个私密的生活,性取向也没有打算公之于众,结果去了一趟机场或者运动场就被摄像头扫描出来了,这样的可能性会让人们感到恐惧。

研究人员之一的 Michal Kosinski 也表示,他们的意图就是警醒人们 AI 的危险性。他认为人工智能和面部识别在不远的将来不仅仅可以识别人的性取向,甚至还能检测出人的政治立场、犯罪倾向,甚至智商。

The Verge 文章还认为,这种从人脸图片判断出性取向的科研成果其实是 19 世纪到 20 世纪的种族主义披上了神经网络、机器学习等计算机技术的外衣,对真正科学的反攻倒算。它像过去的伪科学、相面术一样,给了某些人谴责、灭绝其他人类同胞的理由。

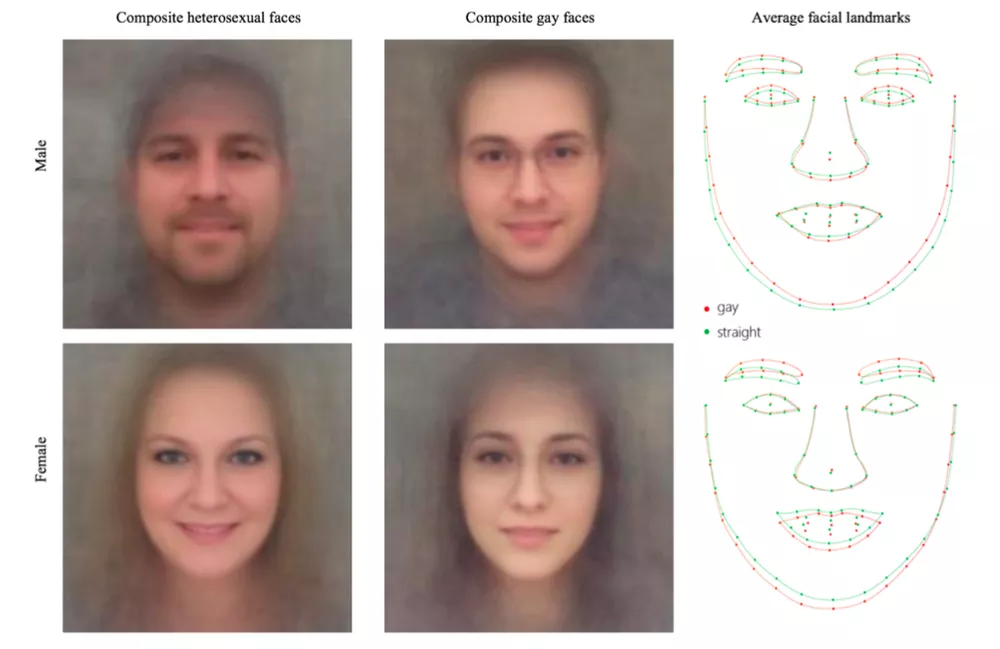

(研究报告中的图片)

从道德的角度看,这项研究确实有着很大的缺陷,但人们也无法否认,机器确实有着人类所没有的分析能力,也许能够发现人类所发现不了的规律和事实。

比如 AlphaGo 就可以从围棋的规则和以往的经典棋局中「研究」出一套独特的棋路,而不是简单的模仿学习。

所以该研究指出的同性人群可能存在不同于异性恋人群的某些特征,从人类的角度我们也不能一昧地从道义上反驳,相反,类似的研究成果可能会被性学专家重视,并加以深入研究。

但另一方面,从训练算法的数据来看,这项研究本身也存在着一定的问题。

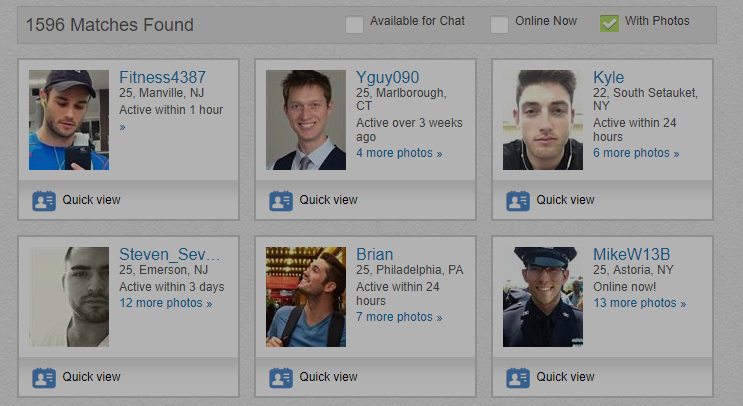

数据源的问题。从婚恋交友网站获取的数十万张照片不能代表人类全体,这些人本身可能就存在着某些特征,而这些特征极有可能会影响到机器对性取向的判断与学习。

(国外某著名约会网站)

数据类型的问题。图片就够了吗?判断一个人的性取向这样重要的特征,简单的静态图片就够了吗?机器也许可以发现人类无法发现的东西,但前提是数据的厚度、密度和广度都必须达到一定的量。

在这一点上,研究者只给机器提供静态的图片作为学习的素材,不禁让人怀疑他们的初衷究竟是出于科学地研究不同人群的潜在特征,还是一些易于媒体传播的商业意图。

(马克·扎克伯格在哈佛校园里做的 FaceMash)

毕竟,从网站上扒图并不是什么技术活,让机器做选择题的概念,也像极了十多年前哈佛某个宅男做的校园选美网站。

参考:The Verge

责任编辑:双筒猎枪